Cloud Exit Strategie: Warum Unabhängigkeit kein Notfallplan ist

Unternehmen sollen Vendor Lock-in aktiv vermeiden, die Portabilität ihrer Anwendungen sicherstellen und die Rückholbarkeit von Daten jederzeit vertraglich wie technisch gewährleisten. Kurz: Wer Cloud nutzt, sollte in der Lage sein, mit vertretbarem Aufwand zu wechseln und Daten in offenen Standardformaten mitzunehmen.

Warum Unabhängigkeit kein Notfallplan ist

Wer einmal versucht hat, einen Cloud-Anbieter zu verlassen, weiß, wie das endet: in einem langen Projekt mit unklarem Ausgang, unerwarteten Kosten und einer langen Liste proprietärer Dienste, die kein Äquivalent beim neuen Anbieter haben. Wie schnell so ein Wechsel akut werden kann, zeigt aktuell die Heroku-Migration auf souveräne Plattformen. Das ist kein Zufall. Es ist Design.

Eine Cloud Exit Strategie ist keine Drohung und kein Misstrauensvotum gegenüber AWS, Azure oder Google Cloud. Es ist die Fähigkeit, jederzeit wechseln zu können, auch wenn du es nie tust. Und genau diese Fähigkeit verändert die Machtstruktur in der Beziehung zu deinem Anbieter grundlegend.

Was eine Cloud Exit Strategie wirklich bedeutet

Die häufigste Verwechslung: Cloud Exit Strategie gleich Cloud-Ausstieg. Das ist falsch. Wer eine Exit-Strategie hat, plant nicht notwendigerweise den Abgang. Er stellt sicher, dass er ihn durchführen könnte, wenn er wollte.

Das ist ein entscheidender Unterschied. Multi-Cloud, also die aktive Nutzung mehrerer Anbieter parallel, ist operativ komplex, teuer und für die meisten Teams schwer zu managen. Cloud-Exit-Readiness dagegen ist ein anderes Konzept: Ein zweiter Anbieter muss nicht täglich genutzt werden. Er muss aber aktivierbar sein, wenn es nötig wird.

Exit-Readiness bedeutet konkret:

- Deine Daten sind portierbar, weil du auf offene Formate setzt

- Deine Applikationen laufen auf einem abstrakten Layer, der nicht an eine proprietäre Laufzeitumgebung gebunden ist

- Dein Team kennt den Prozess für einen Wechsel, nicht theoretisch, sondern dokumentiert

- Du weißt, was ein Wechsel kosten würde, und kannst das in Verhandlungen einbringen

Wie Vendor Lock-in entsteht und warum er so effektiv ist

Lock-in ist selten das Ergebnis einer einzelnen Entscheidung. Er entsteht schleichend, über Monate und Jahre, in drei Dimensionen.

Technischer Lock-in ist der offensichtlichste. Proprietäre Dienste wie AWS Lambda, Google BigQuery oder Azure Service Bus haben keine direkten Äquivalente bei anderen Anbietern. Wer sie nutzt, schreibt Code, der nur dort läuft. Das ist kein Bug, das ist Feature aus Anbietersicht.

Operativer Lock-in ist subtiler. Wenn dein gesamtes Team nur die AWS-Konsole kennt, alle eure Monitoring-Dashboards auf CloudWatch basieren und eure Deployment-Pipelines tief in AWS CodePipeline integriert sind, dann ist ein Wechsel auch ohne technische Hürden ein massives Umschulungs- und Restrukturierungsprojekt.

Kommerzieller Lock-in ist der unterschätzteste. Committed Use Discounts, Reserved Instances und Enterprise Agreements binden nicht nur finanziell, sondern sorgen auch dafür, dass ein Wechsel kurzfristig teurer erscheint als er langfristig wäre. Der Anbieter weiß das. Du solltest es auch wissen.

Datenmobilität: Das Fundament jeder Exit-Strategie

Bevor du über Kubernetes-Portabilität oder Exit-Playbooks nachdenken kannst, musst du eine grundlegende Frage beantworten: Kannst du deine Daten heute vollständig und in einem brauchbaren Format exportieren?

Bei vielen proprietären Datenbankdiensten lautet die ehrliche Antwort: theoretisch ja, praktisch kaum. Exporte sind möglich, aber langsam, teuer (Egress-Kosten) und erfordern erhebliche Nachbearbeitung, weil das Format nicht mit anderen Systemen kompatibel ist.

Praktische Maßnahmen für Datenmobilität:

- Setze auf offene Datenbankformate oder Datenbanken, die woanders betrieben werden können (PostgreSQL statt Aurora, MySQL statt BigQuery)

- Dokumentiere alle Datenquellen und ihre Export-APIs

- Teste Exporte regelmäßig. Nicht als Backup, sondern als Portabilitätscheck

- Kalkuliere Egress-Kosten als Teil deines Total Cost of Ownership

Kubernetes als Portabilitätsschicht nutzen

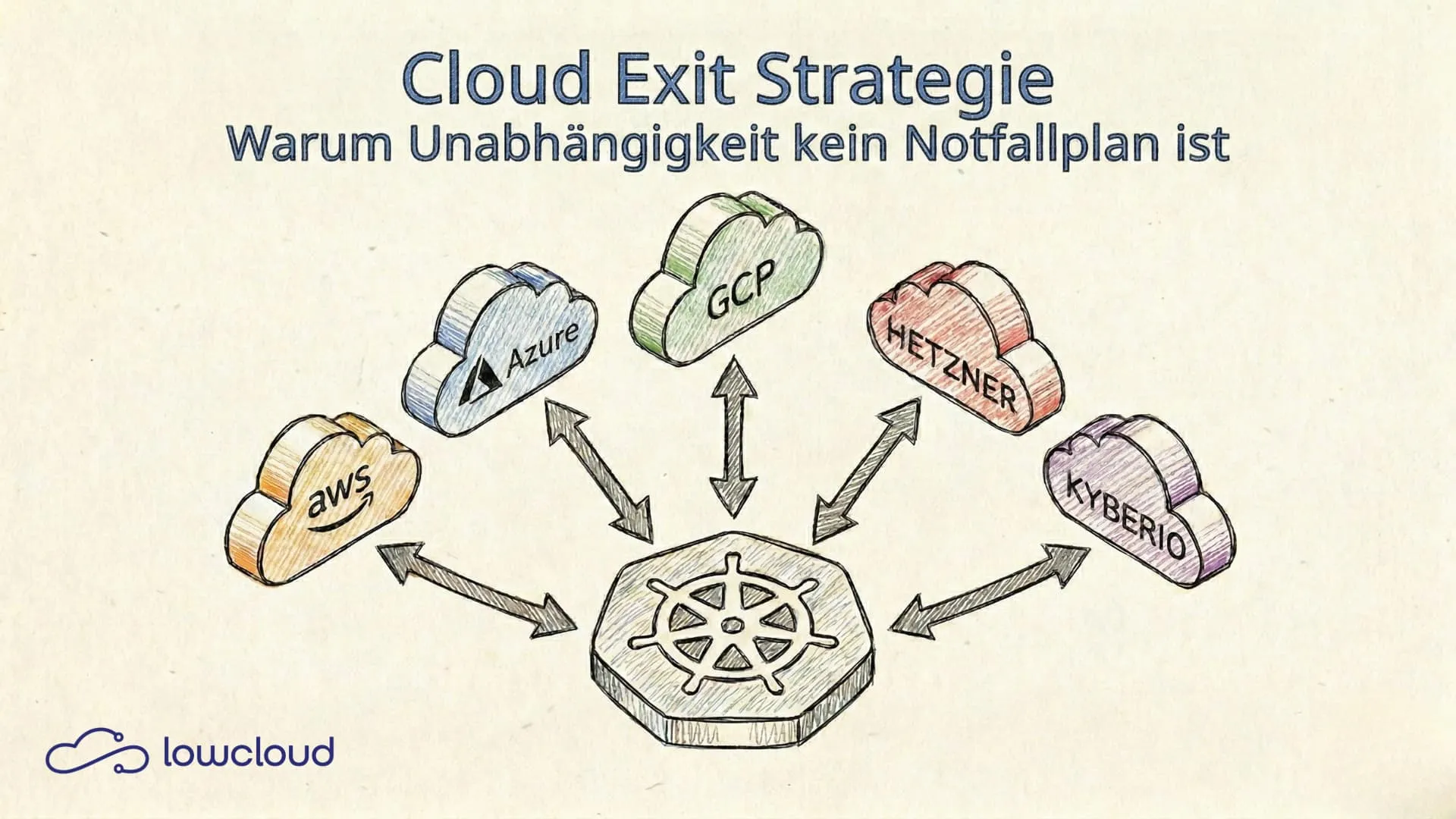

Einer der stärksten Hebel gegen technischen Lock-in ist Kubernetes. Container-Workloads, die auf Kubernetes laufen, sind prinzipiell portabel. Von AWS EKS zu Google GKE zu einem selbst betriebenen Cluster auf eigener Hardware. Die Abstraktionsschicht ist da, wenn du sie konsequent nutzt.

Das „wenn" ist entscheidend. Wer Kubernetes nutzt, aber trotzdem tief auf AWS-spezifische Ingress-Controller, proprietäre Storage-Klassen oder cloud-spezifische IAM-Integrationen setzt, hat die Portabilität nur auf dem Papier.

Cloud-agnostisches Kubernetes bedeutet:

- Standard-Ingress-Controller (z.B. NGINX, Traefik) statt proprietärer Varianten

- Persistente Volumes über CSI-Treiber, die mehrere Backends unterstützen

- Keine harten Abhängigkeiten von cloud-spezifischen IAM-Mechanismen in der Applikationslogik

- Helm Charts und GitOps-Pipelines, die keine Anbieter-spezifischen Befehle enthalten

Das ist mehr Aufwand beim Setup. Es ist deutlich weniger Aufwand beim Wechsel.

Exit-Readiness konkret umsetzen

Eine Exit-Strategie ist kein Dokument, das man einmal schreibt und vergisst. Sie ist ein Zustand, den man aktiv aufrechterhält. Der Einstieg ist einfacher als er klingt.

Schritt 1: Abhängigkeiten inventarisieren

Erstelle eine Liste aller genutzten Cloud-Dienste und kategorisiere sie nach Portierbarkeit:

- Grün: Standard-Dienst mit offenem Äquivalent (z.B. S3-kompatibler Objektspeicher)

- Gelb: Aufwand nötig, aber machbar (z.B. relationale Datenbank mit proprietären Features)

- Rot: Hoher Lock-in, kein direktes Äquivalent (z.B. spezifischer ML-Dienst)

Diese Inventur allein ist wertvoll. Sie zeigt, wo dein Lock-in tatsächlich sitzt – und meistens ist er konzentrierter als gedacht.

Schritt 2: Exit-Kosten quantifizieren

Schätze für jede rote und gelbe Komponente: Was würde ein Wechsel kosten? Migrationsaufwand in Personentagen, Egress-Kosten, Downtime-Risiko, Schulungsaufwand. Das muss keine präzise Kalkulation sein – eine Größenordnung reicht, um fundierte strategische Entscheidungen zu treffen.

Schritt 3: Exit-Playbook schreiben

Dokumentiere für die kritischen Dienste, wie ein Wechsel ablaufen würde. Nicht als Romanliteratur, sondern als operatives Dokument: Reihenfolge der Schritte, verantwortliche Personen, geschätzte Dauer, bekannte Risiken. Das Playbook zeigt dir auch, wo noch Lücken sind. Abhängigkeiten, die niemand im Team vollständig verstanden hat.

Regulatorische Anforderungen als Beschleuniger

DSGVO und DORA haben eines gemeinsam: Sie verlangen, dass Unternehmen nachweislich Kontrolle über ihre IT-Umgebungen haben. Das schließt Cloud-Dienste ein. Seit 2025 fordert auch der EU Data Act Datenportabilität und Anbieterwechsel als technische Pflicht.

Konkret bedeutet das: Du musst zeigen können, wo deine Daten liegen, wer Zugriff hat und was im Fall eines Anbieterausfalls passiert. Eine Exit-Strategie ist kein direktes regulatorisches Muss, aber sie ist ein starkes Argument gegenüber Auditoren und ein strukturierter Weg, die nötige Dokumentation zu erstellen.

Gerade DORA, die Digital Operational Resilience Act, verlangt von Finanzunternehmen explizit Exit-Strategien für kritische IT-Drittanbieter. Was im Finanzsektor schon Pflicht ist, wird in anderen Branchen zunehmend als Good Practice angesehen.

Verhandlungsmacht als unterschätztes Argument

Der pragmatischste Grund für eine Exit-Strategie hat nichts mit Technik zu tun: Wer glaubwürdig mit einem Wechsel drohen kann, verhandelt besser.

Cloud-Anbieter geben signifikante Rabatte, wenn sie wissen, dass der Kunde ernsthaft Alternativen prüft. Enterprise Agreements werden flexibler, Support-Level werden angehoben, technische Konzessionen werden gemacht. Das funktioniert nur, wenn die Drohung glaubwürdig ist – und glaubwürdig ist sie nur mit einer echten Exit-Strategie im Rücken.

Ohne Plan B sitzt du am kürzeren Hebel. Mit Plan B verhandelst du anders.

Was das für 2026 bedeutet

Das Thema ist in der Breite angekommen. Neue Bücher, Frameworks und Beratungsangebote rund um Cloud-Portabilität und Exit-Readiness zeigen: Wer sich jetzt noch nicht damit beschäftigt hat, gerät ins Hintertreffen, nicht gegenüber der Konkurrenz, sondern gegenüber den eigenen Anforderungen an Resilienz, Compliance und strategischer Handlungsfähigkeit.

Eine Exit-Strategie ist keine Angstmaßnahme. Sie ist ein Zeichen, dass man die eigene technologische Basis versteht und kontrolliert. Das ist keine besondere Leistung, es sollte Standard sein.

Wie lowcloud dabei hilft

lowcloud setzt auf Kubernetes als Portabilitäts-Schicht: Deine Anwendungen laufen containerisiert auf einem offenen Standard, statt an proprietäre Cloud-Runtimes gebunden zu sein. Das sorgt dafür, dass dein Deployment-Modell nicht vom nächsten Spezialservice eines einzelnen Hyperscalers abhängt, sondern auf einer Plattform basiert, die du bei mehreren Anbietern identisch betreiben kannst.

Konkret heißt das: Wenn sich Anforderungen ändern, kannst du Workloads mit überschaubarem Aufwand zwischen Anbietern verschieben oder sie in deine eigene Infrastruktur holen. Du bist nicht an eine bestimmte Laufzeitumgebung, ein proprietäres API-Set oder ein kommerzielles Rabatt- und Vertragskorsett gebunden, sondern behältst die Option, den Provider zu wechseln.

lowcloud ist dabei die Kubernetes-PaaS-Schicht, die dir den operativen Aufwand abnimmt: Du bekommst einen konsistenten Weg, Anwendungen auszurollen, zu betreiben und zu aktualisieren, ohne dich tief in provider-spezifische Toolchains einzugraben. Ergebnis: weniger technischer Lock-in, bessere Exit-Readiness und mehr Verhandlungsmacht, weil ein Plan B nicht nur auf dem Papier existiert.

Wenn dich interessiert, wie das konkret aussieht, wirf einen Blick auf die Plattform.

Die souveräne Vercel-Alternative für den Mittelstand: Souveränes Hosting auf Hetzner mit lowcloud

Du suchst die Developer Experience von Vercel, brauchst aber DSGVO-Sicherheit und Kontrolle? lowcloud ermöglicht einfaches Deployment auf Hetzner und garantiert 100% digitale Souveränität.

Cloud Sovereignty Framework: Wie die EU Cloud-Souveränität endlich messbar macht

Mit dem neuen Cloud Sovereignty Framework gibt es erstmals einen strukturierten, prüfbaren Rahmen dafür, was ein Cloud-Dienst leisten muss, um als souverän zu gelten.