DevOps Tool-Chaos: So entsteht und stoppst du Tool-Sprawl

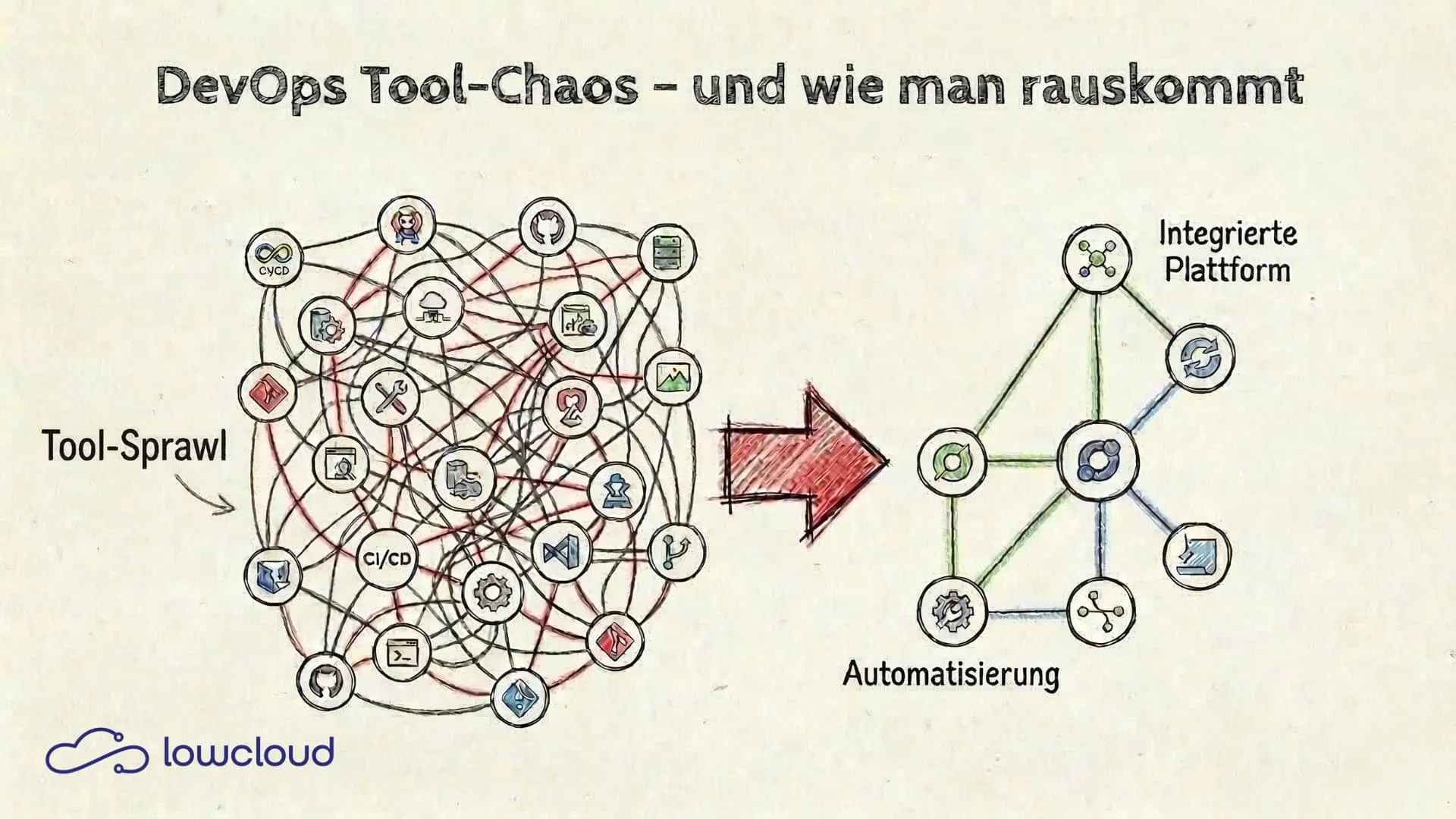

DevOps-Tool-Chaos entsteht selten durch eine einzelne schlechte Entscheidung. Es ist das Ergebnis von Dutzenden pragmatischer Entscheidungen, die jede für sich sinnvoll waren und zusammen ein System ergeben, das niemand mehr vollständig versteht. Dieser Artikel zeigt, wie Tool-Sprawl in der Praxis entsteht, was er wirklich kostet und wie gezielte Standardisierung Teams wieder handlungsfähig macht.

Wie Tool-Sprawl in DevOps-Teams entsteht

Das Muster ist fast immer dasselbe: Ein neues Projekt startet, der Entwickler, der es übernimmt, kennt Jenkins gut, also wird Jenkins eingerichtet. Sechs Monate später kommt ein anderer Entwickler dazu, der GitLab CI bevorzugt. Das nächste Projekt läuft mit GitHub Actions, weil das Repo ohnehin schon dort liegt. Nach zwei Jahren gibt es drei CI-Systeme im Unternehmen, und keiner weiß mehr, welches Projekt wo deployed wird.

Das Gleiche passiert mit Monitoring: Prometheus hier, Datadog dort, CloudWatch für die AWS-Services, und irgendwo noch ein altes Nagios-Setup, das eigentlich niemand mehr anfasst. Tool-Sprawl ist kein Zeichen schlechter Planung, es ist das natürliche Ergebnis von Wachstum ohne aktive Konsolidierung.

Das Problem ist nicht die Entscheidung für ein Tool. Das Problem ist die fehlende Entscheidung gegen das Alte, sobald etwas Neues dazukommt.

Was Tool-Chaos wirklich kostet

Der offensichtliche Kostenfaktor sind Lizenz- und Wartungskosten. Aber die sind fast nie das eigentliche Problem. Die echten Kosten entstehen woanders.

Kognitive Last als unterschätzter Faktor

Jedes Tool bringt eine eigene Konfigurationssyntax, eigene Konzepte, eigene Fehlerbilder. Entwickler, die täglich zwischen Terraform-HCL, Helm-Templates, einer Jenkins-Pipeline-Groovy-Syntax und einem Prometheus-Alerting-YAML wechseln müssen, zahlen dafür einen mentalen Preis. Kognitive Last akkumuliert sich, auch wenn man es nicht direkt merkt.

Das äußert sich in kleineren Dingen: Man schreibt eine Pipeline und muss erst wieder nachschlagen, welche Syntax dieses System verwendet. Man debuggt einen Deployment-Fehler und braucht zehn Minuten, um sich zu erinnern, welches Monitoring-Tool für diesen Service zuständig ist. Einzeln ist das nichts, aber in der Summe kostet es Stunden pro Woche pro Person.

Onboarding: Der versteckte Aufwand

Neuen Teammitgliedern den Einstieg zu ermöglichen ist in tool-reichen Umgebungen aufwendiger als er sein müsste. Nicht wegen der Komplexität der einzelnen Tools, sondern wegen der Anzahl. Wer zu einem Team mit fünf verschiedenen CI-Setups stößt, muss nicht ein System lernen, sondern fünf. Dazu kommen die undokumentierten Eigenheiten jedes Setups, die nur derjenige kennt, der es damals eingerichtet hat.

Das trifft besonders kleine Teams hart, wie unser Artikel über DevOps-Probleme in KMU zeigt. Wenn jemand ausfällt oder das Unternehmen verlässt, ist das Wissen über ein spezifisches Setup oft weg.

Der Unterschied zwischen sinnvoller Vielfalt und echtem Chaos

Nicht jede Tool-Vielfalt ist ein Problem. Manche Spezialisierung ist berechtigt: Ein Security-Team, das andere Anforderungen hat als das Delivery-Team, darf eigene Tools nutzen. Ein Data-Engineering-Setup sieht anders aus als ein Backend-Deployment-Pipeline. Das ist normal.

DevOps Tool-Chaos entsteht, wenn die Vielfalt nicht Anforderungen widerspiegelt, sondern Gewohnheiten. Wenn das gleiche Problem (CI/CD für eine Standard-Web-App) mit drei verschiedenen Lösungen gelöst wird, weil es nie eine Entscheidung gab, welche davon die Standardlösung sein soll.

Der Test ist einfach: Kann jeder im Team für jedes Setup eine Antwort auf die Frage geben, warum dieses Tool für diesen Use Case gewählt wurde? Wenn die Antwort regelmäßig "war halt schon so" ist, ist das kein bewusstes Architekturentscheidung – das ist gewachsenes Chaos.

DevOps Standardisierung in der Praxis

Standardisierung klingt nach Bürokratie, ist aber im Kern Pragmatismus. Wer für jeden neuen Service dieselbe Pipeline-Vorlage nutzt, verschwendet keine Zeit mit Aufbau. Wer dasselbe Monitoring-Setup für alle Services verwendet, findet Probleme schneller, weil er die Dashboards kennt. Standardisierung ist eine Vorab-Investition, die sich bei jedem weiteren Service amortisiert.

Ein CI-System für alle. So geht die Migration

Der erste Schritt ist die Entscheidung für ein System. Das klingt trivial, aber in der Praxis wird sie oft vermieden, weil sie impliziert, dass andere Systeme abgelöst werden müssen. Dabei ist das der eigentliche Punkt.

Kriterien für die Wahl:

- Welches System wird am häufigsten genutzt?

- Welches bietet die beste Integration mit eurem Repository-Hosting?

- Wo liegt das meiste interne Know-how?

Die Migration selbst muss nicht big-bang sein. Ein pragmatisches Vorgehen: Neues System wird Standard für alle neuen Projekte. Bestehende Setups werden migriert, wenn ohnehin Anpassungen anstehen. Innerhalb von sechs bis zwölf Monaten ist die Toollandschaft konsolidiert, ohne dass ein großes Migrationsprojekt gestartet werden musste.

GitOps: Git als Single Source of Truth

GitOps ist kein Tool, sondern ein Prinzip: Der gewünschte Zustand der Infrastruktur und der Deployments ist vollständig in Git beschrieben. Was in Git steht, ist deployed. Was nicht in Git steht, existiert nicht.

Das klingt einfach, hat aber weitreichende Konsequenzen. Es gibt keine manuellen Deployments mehr, die irgendwo dokumentiert werden müssen. Es gibt keinen Drift zwischen dem, was im Monitoring läuft, und dem, was das Team glaubt deployed zu haben. Und es gibt eine klare Audit-Trail für jede Änderung.

Tools wie Argo CD oder Flux implementieren dieses Prinzip auf Kubernetes-Ebene. Aber auch ohne dedizierte GitOps-Tools hilft das Prinzip: Pipeline-Konfigurationen, Helm-Charts, Infrastructure-as-Code – alles in Git, mit Review-Prozessen für Änderungen.

Kubernetes als Standardisierungsschicht

Kubernetes ist nicht nur ein Orchestrator, es ist eine gemeinsame Sprache für Deployments. Wer Kubernetes als Basis nutzt, hat automatisch standardisierte Konzepte: Deployments, Services, ConfigMaps, Secrets, Namespaces. Helm-Charts ermöglichen wiederverwendbare, parametrisierbare Deployment-Vorlagen.

Das reduziert die Tool-Vielfalt auf der Deployment-Ebene erheblich. Statt pro Projekt ein eigenes Deployment-Skript zu schreiben, gibt es eine gemeinsame Helm-Chart-Bibliothek, die für alle Standard-Services verwendet wird. Neue Services folgen dem gleichen Muster. Der Aufwand für Einrichtung und Debugging sinkt.

Plattform Engineering als Lösung für DevOps Tool-Chaos

DevOps Standardisierung lässt sich manuell einführen, aber es kostet Zeit und erfordert disziplinierte Pflege. Der nächste Schritt ist der Übergang zu einem Platform-Engineering-Ansatz: statt jedes Team sein eigenes Setup pflegen zu lassen, stellt ein zentrales Platform-Team eine interne Entwicklungsplattform bereit.

Diese Plattform bündelt die standardisierten Tools, Pipelines und Deployment-Patterns und stellt sie als Self-Service zur Verfügung. Entwickler müssen sich nicht mehr mit CI-Konfiguration oder Kubernetes-Manifests beschäftigen. Sie nutzen die Plattform und können sich auf ihre eigentliche Arbeit konzentrieren.

Für kleinere Teams, die kein eigenes Platform-Team aufbauen können oder wollen, bieten Platform-as-a-Service (PaaS) und DevOps-as-a-Service-Lösungen (DaaS) wie lowcloud diesen Ansatz als Managed Service. Die Plattform bringt die Standards mit: standardisierte Deployment-Workflows auf Kubernetes-Basis, integriertes Monitoring, einheitliche CI/CD-Anbindung. Teams müssen keine eigene Toolchain aufbauen und pflegen. Sie deployen auf einer Plattform, die das bereits für sie gelöst hat.

Tool-Entscheidungen strukturieren: Ein einfaches Framework

Bevor ein neues Tool eingeführt wird, drei Fragen:

1. Löst dieses Tool ein Problem, das wir tatsächlich haben oder eins, das wir antizipieren?

Viele Tools landen in der Toolchain, weil sie in einem Blogpost interessant klangen. Wenn kein konkretes Problem dahintersteht, ist die Wahrscheinlichkeit hoch, dass das Tool nach sechs Monaten nicht mehr aktiv genutzt wird – aber weiter gewartet werden muss.

2. Haben wir bereits ein Tool, das dieses Problem löst?

Manchmal ist die Antwort auf ein Problem nicht ein neues Tool, sondern das bessere Nutzen eines bestehenden. Wer Prometheus bereits hat, braucht kein zweites Alerting-System, er braucht bessere Alerting-Regeln.

3. Wer ist verantwortlich für Betrieb, Updates und Dokumentation?

Ein Tool ohne klaren Owner ist ein zukünftiges Problem. Wenn niemand konkret die Verantwortung übernimmt, wird es früher oder später zum Teil des Chaos.

Diese drei Fragen verhindern keine sinnvollen Tool-Entscheidungen. Sie verhindern impulsive.

Tool-Chaos in DevOps ist lösbar, aber nicht durch ein weiteres Tool. Es erfordert eine bewusste Entscheidung für weniger: weniger Systeme, mehr Tiefe, klarere Standards. Dieses Prinzip gilt auch auf Architekturebene – warum minimalistische Cloud-Architektur stabilere Systeme baut, beschreiben wir separat. Wer auf einer Plattform aufbaut, die diese Standards bereits mitbringt, spart sich die aufwendige Konsolidierungsarbeit und kann sich auf das konzentrieren, was zählt: Software, die funktioniert und deployed werden kann, ohne dass jeder wissen muss, wie genau.

Manuelle Deployments: Unterschätztes Risiko im Mittelstand

Warum manuelle Software-Deployments im Mittelstand zu Ausfällen, Sicherheitslücken und technischen Schulden führen – und wie CI/CD-Automatisierung hilft.

Kubernetes Monitoring: Logs und Metriken richtig einsetzen

Wie Logs und Metriken in Kubernetes zusammenspielen, wo die Unterschiede liegen und was ein solider Monitoring-Stack leisten muss.