Manuelle Deployments: Unterschätztes Risiko im Mittelstand

Viele mittelständische Unternehmen haben ihre Software-Delivery seit Jahren nicht grundlegend verändert. Das manuelle Deployment funktioniert bis es nicht mehr funktioniert. Und dann meistens zur ungünstigsten Zeit.

Was bei manuellen Deployments schiefgeht

Ein Deployment, das aus einer Liste von Schritten in einem Word-Dokument besteht oder im Kopf eines einzelnen Entwicklers lebt, ist kein Prozess. Es ist eine Hoffnung.

Das klingt hart, trifft aber die Realität vieler mittelständischer IT-Abteilungen. Die typischen Szenarien: Ein Entwickler vergisst, eine Konfigurationsdatei zu aktualisieren. Ein anderer führt die Schritte in der falschen Reihenfolge aus, weil die Anleitung seit einem Systemwechsel nicht mehr aktuell ist. Oder eine neue Kollegin übernimmt das Deployment zum ersten Mal und stellt fest, dass das implizite Wissen ihres Vorgängers nirgendwo dokumentiert ist.

Der Faktor Mensch

Das Problem liegt nicht darin, dass Menschen unaufmerksam sind. Es liegt darin, dass manuelle Prozesse von Natur aus variabel sind. Kein Mensch führt denselben Schritt zweimal exakt gleich aus, besonders nicht unter Zeitdruck oder nach einem langen Arbeitstag.

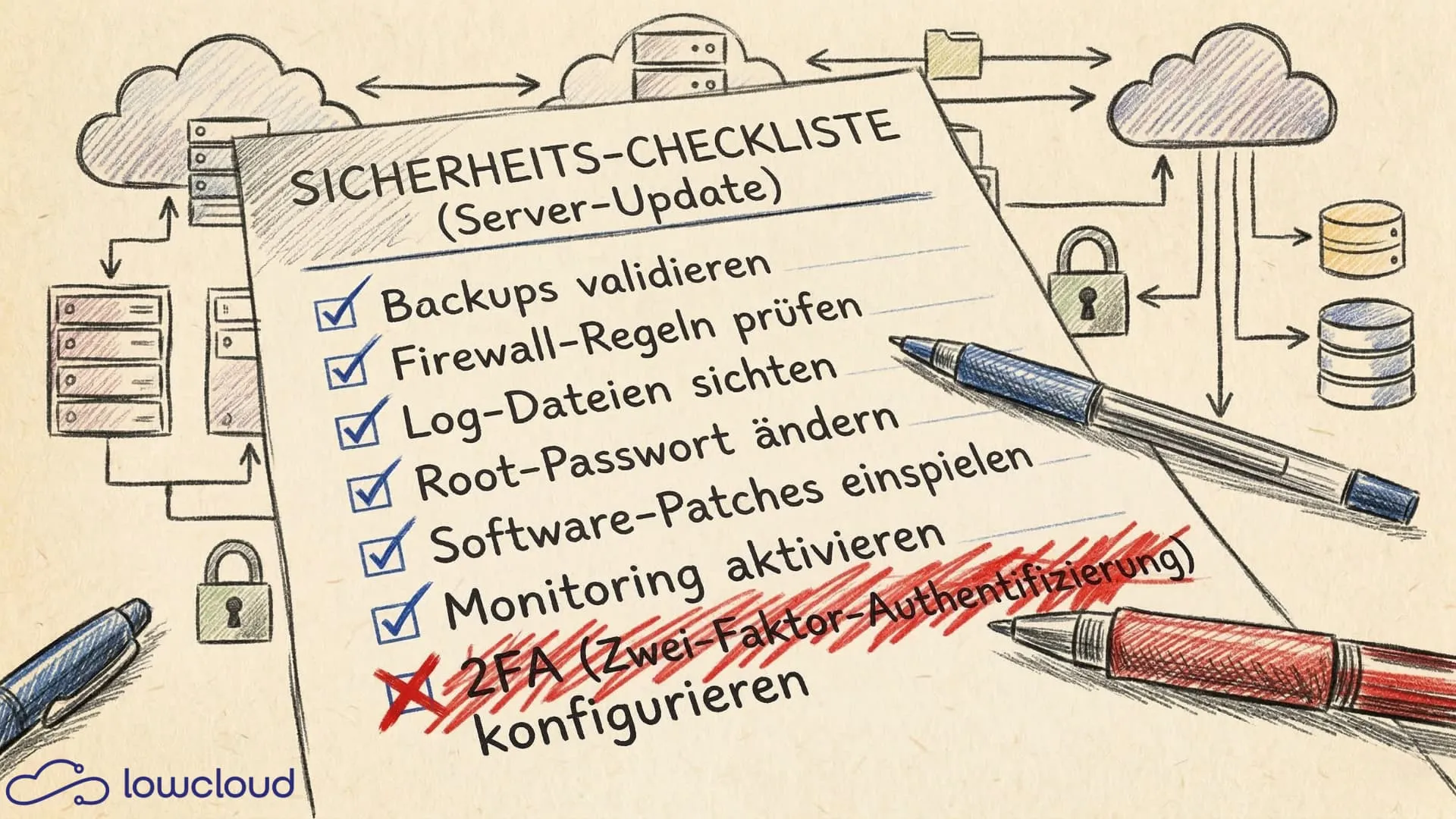

Checklisten helfen, lösen das Problem aber nicht grundlegend. Sie reduzieren die Fehlerrate, eliminieren sie nicht. Und sie funktionieren nur, wenn sie konsequent geführt und aktuell gehalten werden, was in der Praxis selten der Fall ist.

Hinzu kommt: Bei manuellen Deployments fehlt jede Art von automatischer Validierung. Ob die Anwendung nach dem Deployment tatsächlich korrekt läuft, merkt man oft erst, wenn sich Nutzer beschweren.

Kein Rollback, kein Plan B

Was passiert, wenn ein manuelles Deployment fehlschlägt? In automatisierten Pipelines ist ein Rollback eine Frage von Sekunden. Der vorherige Stand wird einfach wieder eingespielt. Bei manuellen Prozessen ist ein Rollback oft genauso aufwändig wie das Deployment selbst, manchmal aufwändiger.

Das führt zu einem gefährlichen Reflex: Fehler werden versucht, auf der laufenden Produktivumgebung zu beheben, anstatt sauber zurückzurollen. Das verschlimmert Ausfälle und verlängert Downtime.

Die versteckten Kosten manueller Prozesse

Die offensichtlichen Kosten eines fehlgeschlagenen Deployments: Downtime, verlorene Transaktionen, genervte Kunden sind noch das Einfachste. Die wirklich teuren Konsequenzen entstehen über Zeit.

Technische Schulden: Weil jeder Entwickler leicht unterschiedlich deployed, schleichen sich Inkonsistenzen in die Produktivumgebung ein. Irgendwann weiß niemand mehr, warum auf dem Produktivserver eine Bibliotheksversion läuft, die eigentlich längst aktualisiert sein sollte.

Sicherheitsrisiken: Patches und Security-Updates werden nicht konsequent eingespielt, weil das Deployment aufwändig ist. Das macht manuelle Prozesse zu einem direkten Sicherheitsproblem – besonders in Branchen mit erhöhten Compliance-Anforderungen.

Verlangsamte Entwicklung: Teams, die Angst vor dem Deployment haben, deployen seltener. Das führt zu größeren, risikoreicheren Releases statt kleiner, kontrollierbarer Änderungen – ein Muster, das den Deployment-Engpass weiter verschärft.

Der Bus-Faktor

Ein Begriff, der in jedem ernsthaften Gespräch über Deployment-Prozesse fallen sollte: der Bus-Faktor. Er beschreibt, wie viele Personen ein Unternehmen verlieren könnte, bevor kritisches Wissen unwiederbringlich verloren geht.

Bei manuellen Deployments liegt der Bus-Faktor erschreckend oft bei eins. Ein einzelner Entwickler kennt den Prozess in allen Details. Wenn diese Person krank wird, das Unternehmen verlässt oder im Urlaub ist, steht das Team vor einem Problem.

Das ist kein hypothetisches Risiko. Es ist ein strukturelles Problem, das sich mit Automatisierung direkt adressieren lässt.

Was Deployment-Automatisierung konkret bedeutet

CI/CD – Continuous Integration und Continuous Delivery – klingt nach einem Konzept für große Tech-Unternehmen mit dedizierten DevOps-Teams. Das stimmt nicht mehr.

Continuous Integration bedeutet im Kern: Jede Code-Änderung wird automatisch gebaut, getestet und validiert. Fehler werden gefunden, bevor sie auf Produktion landen.

Continuous Delivery geht einen Schritt weiter: Der Weg von einer geprüften Code-Änderung bis zur Produktion ist automatisiert und reproduzierbar. Das Deployment selbst kann auf Knopfdruck oder vollautomatisch ausgelöst werden.

Das Ergebnis: Deployments werden zu einem Routinevorgang, nicht zu einem riskanten Eingriff. Das Team kann häufiger, sicherer und mit mehr Vertrauen releasen.

CI/CD im Mittelstand: Wo anfangen?

Der häufigste Fehler beim Einstieg in Deployment-Automatisierung ist der Versuch, sofort die perfekte Lösung zu implementieren. Das führt zu monatelangen Planungsphasen ohne greifbare Ergebnisse.

Ein pragmatischer Ansatz funktioniert besser:

- Den aktuellen Deployment-Prozess dokumentieren – auch wenn er chaotisch ist. Nur was dokumentiert ist, lässt sich automatisieren.

- Einen einfachen Build-Schritt automatisieren – z. B. das Bauen eines Container-Images bei jedem Git-Push.

- Automatisierte Tests hinzufügen – selbst einfache Smoke-Tests sind besser als keine Tests.

- Das Deployment auf eine Staging-Umgebung automatisieren – Produktion kommt später.

Jeder dieser Schritte liefert sofortigen Mehrwert und baut das Vertrauen des Teams in automatisierte Prozesse auf. Einen vollständigen Fahrplan für Software Deployment im KMU haben wir in einem separaten Artikel zusammengestellt.

Kubernetes und DevOps-as-a-Service als Beschleuniger

Kubernetes hat sich als De-facto-Standard für Container-Orchestrierung etabliert, auch im Mittelstand. Die Technologie bietet genau das, was manuelle Deployments nicht können: deklarative Konfiguration, automatisches Rollback, Health Checks und Skalierung.

Die Herausforderung: Kubernetes selbst ist komplex. Den Cluster aufzusetzen, zu betreiben und zu warten, erfordert Expertise, die viele mittelständische Teams nicht im Haus haben.

Hier kommen DaaS-Plattformen ins Spiel. Sie abstrahieren die Kubernetes-Komplexität und bieten strukturierte Deployment-Workflows, ohne dass das Team tief in Cluster-Management einsteigen muss. lowcloud ist eine solche Plattform. Entwickelt für Teams, die die Vorteile von Kubernetes nutzen wollen, ohne eine eigene Plattform-Engineering-Abteilung aufzubauen.

Das bedeutet konkret: Deployments werden über eine definierte Pipeline ausgelöst, Rollbacks sind automatisiert, und der Zustand der Anwendung ist jederzeit nachvollziehbar. Der Entwickler konzentriert sich auf Code, nicht auf Deployment-Infrastruktur.

Fazit: Wann ist der richtige Zeitpunkt?

Die häufigste Antwort auf die Frage, wann ein Unternehmen mit Deployment-Automatisierung anfangen sollte, lautet: "Wenn wir mehr Zeit haben" oder "Wenn das aktuelle Projekt abgeschlossen ist."

Diese Zeit kommt nicht. Manuelle Prozesse erzeugen kontinuierlich Aufwand, der andere Projekte verzögert. Der richtige Zeitpunkt war gestern – der zweitbeste ist heute.

Der Einstieg muss nicht groß sein. Ein automatisierter Build-Schritt, ein einfacher Test, ein reproduzierbares Deployment auf Staging. Das reicht für den Anfang. Was nicht reicht, ist weiterzumachen wie bisher und zu hoffen, dass das nächste manuelle Deployment ohne Probleme läuft.

Bereit, Deployments aus dem Risikobereich zu holen? lowcloud bietet eine Kubernetes-basierte PaaS-Plattform, die Deployment-Automatisierung für mittelständische Teams zugänglich macht – ohne monatelangen Infrastruktur-Aufbau. Mehr erfahren

n8n selbst hosten auf Hetzner: Komplette Docker-Anleitung

Schritt für Schritt: n8n mit Docker auf einem Hetzner VPS deployen. Inkl. Reverse Proxy, SSL, Backups und Datensouveränität — ohne Managed Cloud.

DevOps Tool-Chaos: So entsteht und stoppst du Tool-Sprawl

Tool-Sprawl kostet mehr als Lizenzen: kognitive Last, langsames Onboarding, verlorenes Wissen. So bringst du Ordnung in dein DevOps-Setup.