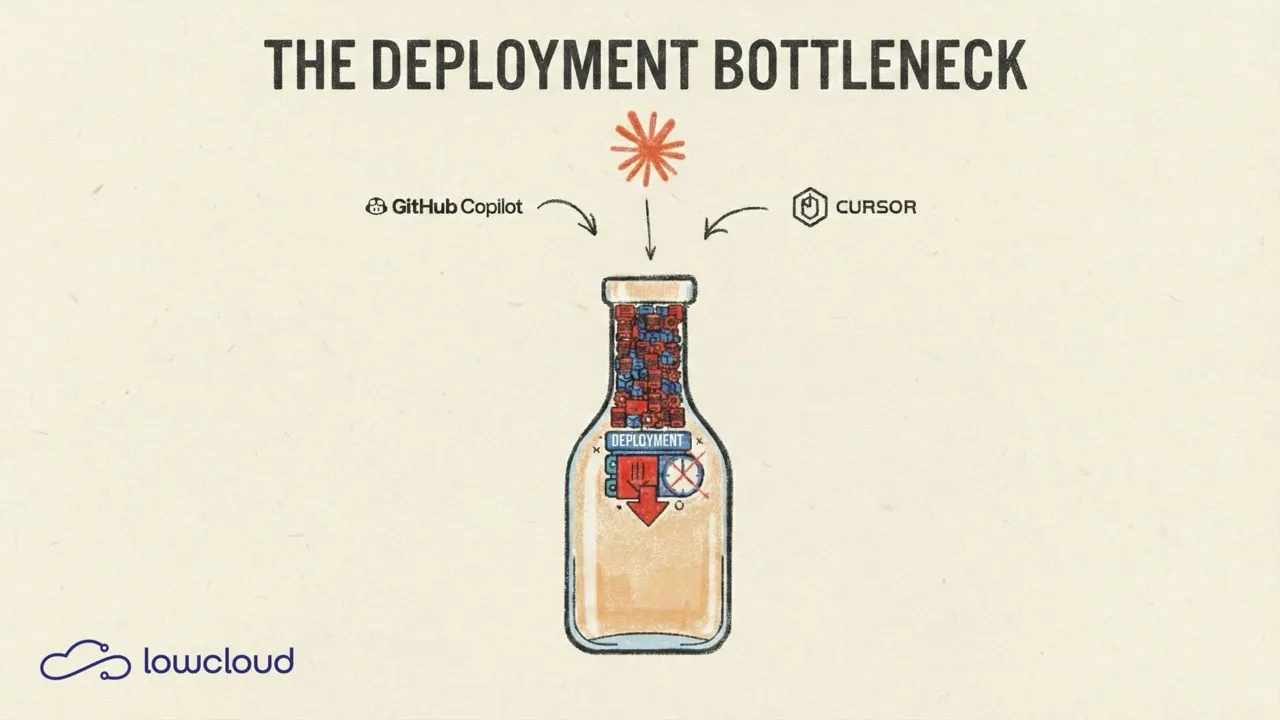

Deployment als Bottleneck: Wenn KI schneller coden kann als du deployen kannst

KI-Tools wie GitHub Copilot, Cursor und Claude haben die Art, wie Entwicklerinnen und Entwickler Code schreiben, grundlegend verändert. Features, für die früher Tage benötigt wurden, entstehen heute in wenigen Stunden. Doch während die Code-Produktion durch KI auf ein neues Niveau gehoben wurde, hinkt ein kritischer Teil des Software-Delivery-Prozesses hinterher: das Deployment. Wer heute schnell coden kann, aber langsam deployt, hat das Bottleneck nicht eliminiert. Es wurde nur nach hinten verschoben.

Der neue Engpass im Software-Development

Was hat sich durch KI verändert?

KI-gestützte Entwicklungswerkzeuge sind keine Zukunftsmusik mehr. Laut einer Studie von GitHub aus dem Jahr 2023 sind Entwickler mit Copilot bis zu 55 % schneller bei der Erledigung von Coding-Aufgaben. In der Praxis bedeutet das: Mehr Code, mehr Features, mehr Pull Requests und das in kürzerer Zeit.

Das klingt zunächst nach einem reinen Gewinn. Doch mit steigender Code-Produktion wächst auch der Druck auf alle nachgelagerten Prozesse. Tests müssen schneller laufen. Code Reviews müssen skalieren.

Und vor allem: Deployments müssen zuverlässig, schnell und reproduzierbar sein.

Warum das Deployment nicht mitgewachsen ist

Deployment-Infrastrukturen wachsen selten organisch mit der Entwicklungsgeschwindigkeit mit. Viele Teams arbeiten noch mit Pipelines, die vor Jahren aufgesetzt wurden, zu einer Zeit, als ein Deployment pro Woche der Standard war. Manuelle Freigaben, handgeschriebene Shell-Skripte, fehlende Rollback-Mechanismen – klassische Symptome der häufigsten DevOps-Probleme in KMU. Das alles war tolerierbar, solange der Nachschub an Code überschaubar blieb.

In einer Welt, in der KI die Code-Produktion teils verzehnfacht, werden genau diese Schwachstellen zum kritischen Bottleneck.

Was macht Deployment zum Bottleneck?

Manuelle Schritte und fehlende Automatisierung

Einer der häufigsten Gründe für langsame Deployments: Zu viele manuelle Eingriffe im Prozess. Ein Entwickler erstellt einen Pull Request, wartet auf ein Code Review, wartet auf eine Staging-Freigabe und wartet schließlich auf das Ops-Team für das Produktions-Deployment. Jeder dieser Warteschritte kostet Zeit. In Summe entstehen Wartezeiten von Stunden oder Tagen, obwohl der eigentliche Code in Minuten fertig war.

Automatisierung ist hier der absolute Schlüssel – und der größte Hebel, um IT-Kosten zu senken. Eine vollständige CI/CD-Pipeline, die vom Commit bis zum Deployment reicht, reduziert manuelle Eingriffe auf ein Minimum. So sind konsistente, reproduzierbare Deployments garantiert.

Umgebungskonflikte und Konfigurationschaos

„Es funktioniert auf meinem Rechner" ist ein Klassiker. Aber auch „Es funktioniert in Staging, nicht in Produktion" ist erschreckend verbreitet.

Unterschiedliche Umgebungsvariablen, abweichende Abhängigkeitsversionen oder nicht versionierte Konfigurationen. All das führt zu schwer nachvollziehbaren Deployment-Fehlern.

Tools wie Docker und Kubernetes adressieren dieses Problem durch Containerisierung und deklarative Infrastrukturbeschreibungen. Doch sie bringen leider ihre völlig eigene Komplexität mit in den Ring.

Kubernetes-Komplexität als Hürde

Kubernetes ist heute der De-facto-Standard für Container-Orchestrierung. Gleichzeitig ist es eine der komplexesten Plattformen im modernen Software-Stack. Wie Zero-Config-Kubernetes die Komplexität reduziert, zeigt unser separater Artikel. Wer Kubernetes selbst betreibt, muss sich mit YAML-Manifesten, Ingress-Controllern, RBAC-Konzepten, Storage Classes, Netzwerkpolicies und einer Fülle von Operatoren auseinandersetzen.

Für viele Entwicklungsteams ist diese Komplexität eine echte Hürde. Zeit, die in die Pflege der Kubernetes-Infrastruktur fließt, fehlt bei der eigentlichen Produktentwicklung. Das Deployment Bottleneck entsteht hier nicht durch fehlende Werkzeuge, sondern durch die drückende Betriebslast der Plattform selbst. Das ist strukturell das gleiche Problem, das wir als kognitive Überlastung in Full-Stack-Rollen beschreiben.

DORA-Metriken: Wo das Deployment Bottleneck messbar wird

Das DevOps Research and Assessment-Programm (DORA) hat vier Schlüsselmetriken definiert, mit denen sich die Leistungsfähigkeit von Software-Delivery-Prozessen objektiv messen lässt:

- Deployment Frequency: Wie oft wird in Produktion deployt?

- Lead Time for Changes: Wie lange dauert es vom Commit bis zum Produktions-Deployment?

- Change Failure Rate: Wie oft führen Deployments zu Ausfällen?

- Mean Time to Restore (MTTR): Wie schnell wird ein Fehler behoben?

Elite-Teams laut DORA deployen mehrmals täglich. Sie haben eine Lead Time von unter einer Stunde und erholen sich von Incidents in weniger als einer Stunde. Wenn das eigene Team hier deutlich schlechter abschneidet, ist das ein klares Signal. Das Deployment ist der bremsende Faktor.

Den Deployment Bottleneck auflösen: Strategien

GitOps-Workflows einführen

GitOps ist ein Ansatz, bei dem Git als Single Source of Truth für den gesamten Infrastruktur- und Anwendungszustand dient. Jede Änderung, ob Code oder Konfiguration, wird als Pull Request abgebildet und durch eine Pipeline automatisch in die Zielumgebung überführt.

Tools wie Argo CD oder Flux setzen dieses Prinzip für Kubernetes-Umgebungen um. Das Ergebnis sind vollständig automatisierte, auditierbare Deployments. Manuelle Eingriffe entfallen und Rollbacks sind durch ein simples git revert machbar.

CI/CD-Pipelines modernisieren

Eine moderne CI/CD-Pipeline geht weit über das simple Bauen und Pushen eines Docker-Images hinaus. Wie KMU den Einstieg in CI/CD konkret umsetzen, zeigen wir in einem eigenen Artikel. Sie umfasst:

- Automatisierte Tests (Unit, Integration, End-to-End)

- Security Scanning (Container-Images, Dependencies)

- Canary Deployments oder Blue-Green-Deployments für risikoarme Rollouts

- Automatische Rollbacks bei fehlgeschlagenen Health Checks

Wer seine Pipeline auf diesen Stand bringt, beseitigt nicht nur den Flaschenhals bei der Deployment-Frequenz. Er senkt auch drastisch die Fehlerquote.

Plattformen nutzen und Komplexität abstrahieren

Nicht jedes Team hat die Kapazität, eine vollständige Kubernetes-Infrastruktur selbst zu betreiben und zu optimieren. Hier setzen Platform Engineering und Platform-as-a-Service-Lösungen (PaaS) an. Sie abstrahieren die Komplexität von Kubernetes spürbar. Entwicklungsteams erhalten eine einfache, selbstbedienbare Oberfläche für ihre Deployments.

Statt YAML-Manifeste endlos zu pflegen und Kubernetes-Ressourcen manuell zu konfigurieren, deployen Teams direkt aus dem Git-Repository. Automatisierte Pipelines, vordefinierten Umgebungen und integriertes Monitoring sind direkt an Bord.

Wie eine PaaS-Plattform das Deployment befreit

Eine moderne Kubernetes-PaaS-Plattform wie lowcloud greift das Deployment Bottleneck auf mehreren Ebenen gleichzeitig an:

Self-Service-Deployments: Entwicklerinnen und Entwickler deployen ihre Anwendungen eigenständig. Das Warten auf ein Ops-Team entfällt komplett, was einen der zähesten Warteschritte löscht.

Automatisierte Pipelines: Aus einem einfachen Push entsteht direkt ein echtes Deployment. Build, Test und Rollout passieren gebündelt. Lead Times von unter einer Stunde sind somit für jedes Team ein greifbares Ziel.

Kubernetes ohne Kopfschmerzen: Die komplette Kubernetes-Infrastruktur wird von der Plattform verwaltet. Das Team kann sich zu 100 % auf die Anwendung stürzen. Cluster-Upgrades, Node-Konfigurationen oder Netzwerkpolicies laufen im Hintergrund.

Integriertes Monitoring und Rollback: Geht ein Rollout schief, greift automatisch das Rollback. Metriken und Logs liegen direkt in der Plattform bereit, externe Toolchains sind dafür nicht zwingend nötig.

Das bringt klare Resultate: Wo früher stundenlange Prozesse den Workflow blockierten, wird heute mehrmals täglich deployt – mit mehr Sicherheit und praktisch ohne manuellen Aufwand.

Ausblick: KI auch im Deployment?

Wenn KI die Code-Produktion derart beschleunigt hat, drängt sich die Frage auf. Wird KI auch das Deployment übernehmen?

Die Antwort ist ein klares Ja. Die ersten konkreten Ansätze sind bereits heute stark:

- Automatisiertes Test-Writing: KI schreibt nicht nur den Code, sondern auch die passenden Tests dazu. Das pusht die Qualität der Pipeline.

- Intelligentes Rollback: Die Erkennung von feinen Anomalien in den Metriken löst automatisch Rollbacks aus, noch lange bevor ein User den Bug sieht.

- Predictive Scaling: KI-gestützte Autoscaler analysieren Traffic-Muster und skalieren Ressourcen vorausschauend, nicht erst wenn das System schwitzt.

- KI-Diagnose bei Incidents: Tools lesen Logs und Metriken vollautomatisch aus und machen direkt Lösungsvorschläge.

Wichtig bleibt aber: KI fungiert hier als kraftvoller Verstärker. Sie ersetzt jedoch keine grundsolide Deployment-Plattform.

Auch die cleverste KI benötigt ein Fundament, auf dem sie sicher und reproduzierbar arbeiten darf:

- Sie fordert standardisierte Deployments, keine handgeklöppelten Bastel-Pipelines.

- Sie benötigt glasklare Isolation zwischen Dev, Staging und Produktion.

- Sie braucht harte Leitplanken in Form von Policies, sicherem Secrets-Handling und strengen Audit-Logs.

- Sie ist auf lückenlose Observability (Logs, Metriken) angewiesen, um überhaupt vernünftig agieren zu können.

Genau an diesem Punkt kommt lowcloud ins Spiel. Er liefert exakt diese stabile, souveräne Basis für Kubernetes-Deployments. Die Self-Service-Modelle, CI/CD-Prozesse und das saubere Monitoring machen komplexe oder gar KI-gestützte Rollouts in der Praxis überhaupt erst sicher nutzbar.

Die Zukunft der Software-Auslieferung wird ohnehin automatisiert sein. Doch sie wird eben auch hochgradig intelligent.

Das verlangt zwingend nach einer Plattform, die die extreme Komplexität einfängt und harte Sicherheit garantiert. Nur so sorgt die KI künftig nicht nur für schnelleren Code, sondern auch für kontrollierte, sichere Deployments.

Und jetzt?

Niemand bestreitet mehr, dass KI das Coding drastisch beschleunigt hat. Wer allerdings die volle Wucht dieser Beschleunigung spüren will, muss sein Deployment aus dem Dornröschenschlaf holen. Der klassische Deployment-Prozess ist heute verlässlich das allergrößte Nadelöhr im Software-DeliveryKreislauf.

Die richtig guten Nachrichten: Niemand muss das Rad neu erfinden. Die Werkzeuge und Best Practices, um diesen Flaschenhals zu sprengen, liegen auf dem Tisch. Moderne CI/CD-Pipelines, GitOps und durchdachte Kubernetes-PaaS-Ansätze lassen Teams jeder denkbaren Größe schnell und unfallfrei deployen. All das klappt heute, ohne zwingend die massiven Ops-Kosten für einen nackten Kubernetes-Cluster tragen zu müssen.

lowcloud liefert exakt diesen Hebel. Keine Betriebslast, dafür Self-Service und Tempo. So schnell, wie dein Code dank KI entsteht, sollte er auch bei den Usern ankommen. Lerne mehr über lowcloud und roll dein erstes Deployment noch heute verlässlich aus.