Software Deployment KMU: Schneller und sicherer ausrollen

Viele KMU verbringen mehr Zeit damit, Software bereitzustellen, als sie weiterzuentwickeln. Der Grund ist selten fehlendes Können, es sind gewachsene Prozesse, die nie für Geschwindigkeit optimiert wurden. Das lässt sich ändern, ohne ein Platform-Engineering-Team aufzubauen.

Warum langsames Deployment mehr kostet als es spart

Ein Bugfix, der drei Tage braucht, bis er beim Kunden ankommt, ist kein technisches Problem. Es ist ein Geschäftsproblem. Jede Stunde zwischen fertigem Code und produktivem System ist eine Stunde, in der Fehler sichtbar bleiben, Features nicht genutzt werden und Entwickler auf Feedback warten statt weiterzuarbeiten.

In klassischen KMU-Umgebungen sieht das Deployment-Bild oft so aus: Ein Entwickler baut lokal, schickt ein Archiv per FTP auf den Server, loggt sich per SSH ein und startet den Dienst neu. Funktioniert es nicht, beginnt die Fehlersuche. Das kostet Zeit, erzeugt Stress und bedeutet: Je öfter man deployed, desto mehr Aufwand entsteht. Ein direkter Anreiz, seltener auszurollen.

Die typischen Muster in KMU

Das Problem liegt selten an einzelnen Personen. Es liegt an fehlenden Strukturen. Wenn niemand eine Deployment-Pipeline gebaut hat, weil „es bisher funktioniert hat", entsteht ein System, das für wenige Releases im Monat akzeptabel ist, aber spätestens bei mehreren Teams oder mehreren Services zusammenbricht.

Dazu kommt die Angst vor dem Deploy-Button. Wenn Deployments manuell sind und keine Rollback-Option existiert, ist jeder Rollout ein kleines Wagnis. Diese Angst verlangsamt alles, nicht nur die Technik, sondern die gesamte Entwicklungskultur.

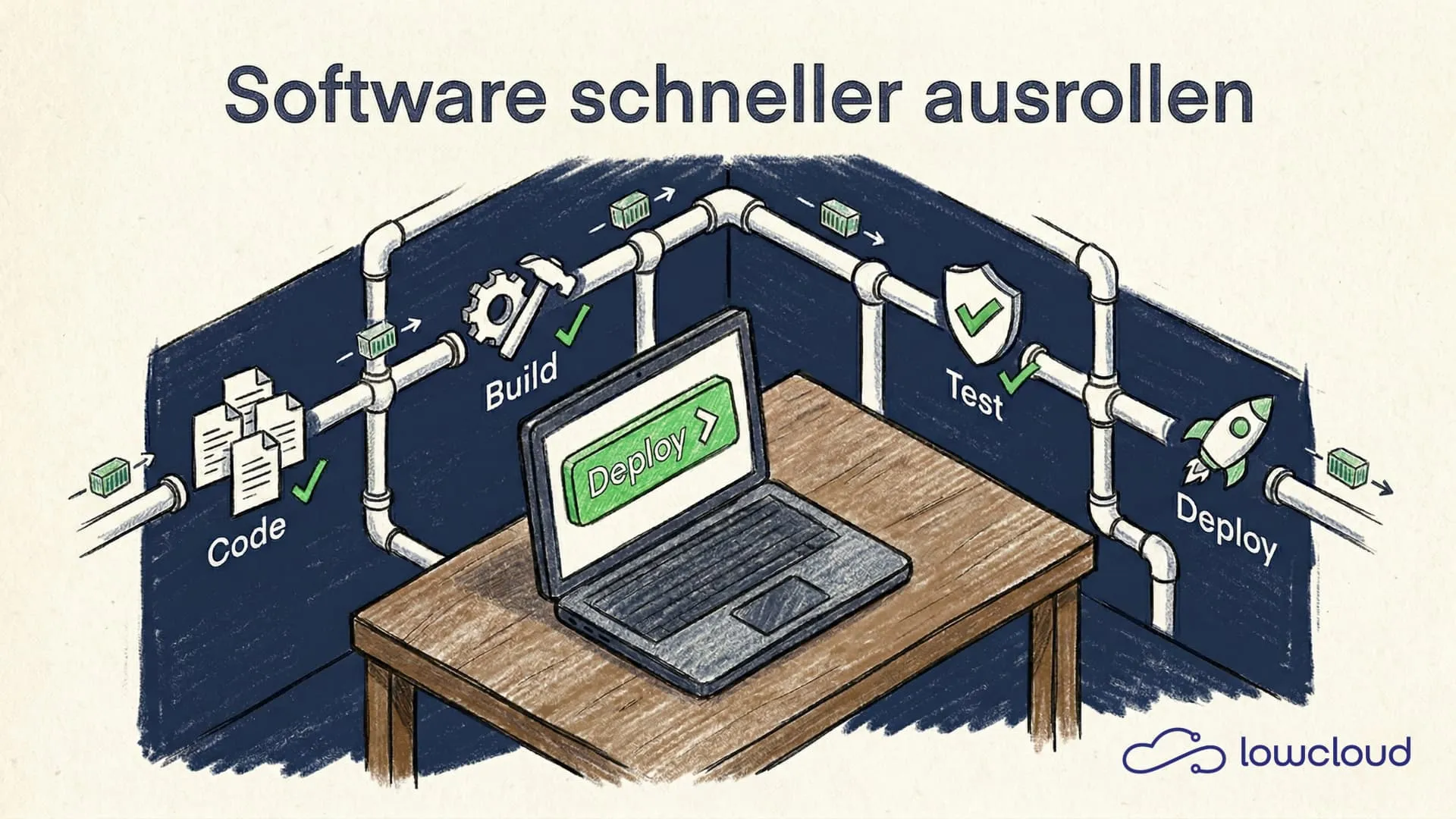

CI/CD für KMU. Was das konkret bedeutet

Continuous Integration (CI) und Continuous Delivery (CD) klingen nach Enterprise-Infrastruktur, sind aber im Kern eine simple Idee: Jeder Code-Commit löst automatisch eine Kette aus: Tests laufen, ein Build entsteht, das Ergebnis landet in der Zielumgebung. Kein Mensch muss manuell eingreifen.

Für ein KMU bedeutet das nicht zwingend Kubernetes, Multi-Cluster-Setups oder ein dediziertes Platform-Team. Es bedeutet: eine Pipeline, die deterministisch und wiederholbar ist. Wenn dieselben Schritte immer zum selben Ergebnis führen, wird Deployment langweilig und langweilig ist genau das, was man will.

Was eine gute Pipeline leisten muss

Eine brauchbare CI/CD-Pipeline für ein KMU braucht nicht viel:

- Automatische Tests – Unit-Tests, zumindest Smoke-Tests. Kein Deploy ohne grüne Tests.

- Reproduzierbarer Build – Container-Images sind das Mittel der Wahl. Einmal gebaut, überall deploybar.

- Automatisches Deployment – in Staging zuerst, dann in Produktion, idealerweise mit manuellem Approval-Schritt für kritische Umgebungen.

- Rollback-Mechanismus – das vorherige Image muss in unter fünf Minuten wieder aktiv sein.

Tools wie GitHub Actions, GitLab CI oder Woodpecker CI decken das ab. Kostenlos, in kleinen Teams betreibbar, mit ausreichend Dokumentation.

Kubernetes und PaaS. Der Unterschied zwischen Aufwand und Nutzen

Kubernetes ist die Basis der meisten modernen Deployment-Infrastrukturen. Aber Kubernetes selbst zu betreiben ist aufwendig. Cluster-Upgrades, Networking-Konfiguration, Storage-Klassen, RBAC, Monitoring. Das sind alles Themen, die ein kleines Team nicht nebenbei lösen kann.

Genau hier setzt eine PaaS-Plattform (Platform as a Service) an. Statt einen Kubernetes-Cluster selbst zu verwalten, bekommt das Entwicklungsteam eine vorkonfigurierte Umgebung, in der es Anwendungen deployen kann – ohne sich um die darunterliegende Infrastruktur zu kümmern.

Das klingt nach einer kleinen Vereinfachung. In der Praxis ist es ein Unterschied von Wochen bis Monaten an Setup-Aufwand.

Was eine PaaS-Plattform konkret abnimmt

Eine gut gebaute PaaS-Plattform übernimmt:

- Cluster-Management und Upgrades – Kubernetes-Versionen werden ohne Downtime aktualisiert

- Networking – Ingress, TLS-Zertifikate, interne Service-Discovery

- Skalierung – Horizontal Pod Autoscaler funktioniert out-of-the-box

- Basis-Monitoring – Metriken und Logs sind sofort verfügbar, ohne Prometheus selbst aufzusetzen

- Zugriffsverwaltung – Teams bekommen isolierte Namespaces ohne Kubernetes-Expertenwissen

Für ein KMU bedeutet das: Die Entwickler können sich auf ihre Anwendungen konzentrieren. Die Plattform löst die Infrastrukturprobleme.

DevOps as a Service: PaaS plus Umsetzung, Betrieb und Verantwortung

Eine DevOps as a Service Plattform erweitert den Ansatz von PaaS um das, was bei vielen KMU trotzdem noch liegen bleibt: laufende Umsetzung, Betrieb und kontinuierliche Optimierung durch ein externes Team.

Während eine PaaS-Plattform den Standardfall produktisiert (Provisioning, Deployments, Skalierung, Baseline-Observability), übernimmt DevOps as a Service zusätzlich typischerweise:

- Pipeline- und Plattform-Engineering „done for you": CI/CD, GitOps-Setup, Helm/Kustomize, Release-Prozesse.

- Betrieb & Incident Response: Monitoring, Alerting, On-Call, Troubleshooting, Postmortems.

- Security & Compliance-Arbeit: Hardening, Policies, Patch-Management, Audits/Docs.

- Migrationen & Spezialfälle: Legacy-Workloads, Sonder-Integrationen, „nicht-Standard"-Deployments.

Die Vorteile sind klar, vor allem, wenn Geschwindigkeit kurzfristig wichtiger ist als internes Enablement:

- Schneller Start: Ergebnis in Tagen statt Wochen, ohne sofort DevOps-Hires.

- Erfahrene Umsetzung: Best Practices kommen direkt mit.

- Entlastung im Alltag: Weniger Unterbrechungen im Dev-Team, weniger Produktionsstress.

Der Trade-off: Je mehr über Menschen gelöst wird, desto eher entstehen Abhängigkeit, Koordinationsaufwand und variable Kosten. Genau deshalb ist der Sweet Spot für viele Teams: PaaS als Standard-Produkt + DevOps as a Service. In diesen Fällen bieten sich dann DevOps-as-a-Service-Plattformen, wie lowcloud an.

GitOps als Workflow: Push to deploy ohne Magie

GitOps ist kein Tool, sondern ein Prinzip: Das Git-Repository ist die einzige Quelle der Wahrheit für den Zustand der Infrastruktur und der Anwendungen. Jede Änderung, ob neues Feature, Konfigurationsupdate oder Rollback, passiert als Commit in Git.

Für ein KMU hat das einen praktischen Vorteil: Es gibt keinen gesonderten „Deploy-Prozess" mehr. Push in den Hauptbranch, Pipeline läuft, Anwendung ist aktuell. Das Deployment-Log ist die Git-History – nachvollziehbar, rückgängig zu machen, von jedem im Team einsehbar.

Tools wie Argo CD oder Flux synchronisieren den gewünschten Zustand aus Git mit dem tatsächlichen Zustand im Kubernetes-Cluster. Weicht der Cluster ab – etwa weil jemand manuell etwas geändert hat – korrigiert das System sich automatisch.

Sicherheitsnetz: Rollbacks und Canary Deployments

Schneller deployen heißt nicht, mehr Risiko einzugehen. Es heißt, das Risiko pro Deployment kleiner zu machen, durch häufigere, kleinere Änderungen und durch Mechanismen, die Probleme frühzeitig erkennen.

Ein Rollback bedeutet im Container-Kontext: Das vorherige Image-Tag wird wieder aktiv gesetzt. Kubernetes führt das als Rolling Update aus: null Downtime, bekannter Ablauf. Wer seine Pipeline richtig konfiguriert hat, kann einen Rollback in weniger als einer Minute ausführen.

Canary Deployments gehen einen Schritt weiter: Ein neues Release bekommt zunächst nur einen kleinen Prozentsatz des Traffics. Wenn Fehlerrate und Latenz normal bleiben, rollt das System schrittweise aus. Bei Problemen wird automatisch zurückgefallen. Das ist kein Konzept für große Unternehmen – es ist eine Risikominimierungsstrategie, die gerade für KMU sinnvoll ist, weil Fehler in Produktion teuer sind.

Wo KMU heute konkret anfangen können

Der häufigste Fehler beim Versuch, Deployments zu beschleunigen: zu viel auf einmal. Kubernetes, CI/CD, GitOps, Monitoring – alles in einem Sprint. Das Ergebnis ist ein halbfertiges Setup, das niemand versteht und alle frustriert.

Ein sinnvoller Einstieg sieht so aus:

- Schritt 1: Containerisierung – Jede Anwendung bekommt ein Dockerfile. Wer noch keinen Docker-Build hat, startet hier.

- Schritt 2: Einfache CI-Pipeline – GitHub Actions oder GitLab CI bauen das Image bei jedem Commit. Tests laufen automatisch.

- Schritt 3: Managed Deployment-Ziel – Statt selbst Kubernetes zu betreiben, nutzt das Team eine PaaS-Plattform, die den Cluster managt.

- Schritt 4: GitOps-Workflow einführen – Deployments passieren durch Commits, nicht durch manuelle Befehle.

- Schritt 5: Rollback-Prozess dokumentieren und testen – Einmal ausprobiert, bevor man ihn braucht.

Wer diesen Weg geht, kann innerhalb weniger Wochen von manuellen Deployments zu einem vollständig automatisierten Workflow kommen, ohne ein Platform-Team einzustellen.

Realistischer Zeithorizont: Ein erfahrener Entwickler kann Schritt 1 bis 3 in ein bis zwei Wochen umsetzen, wenn die Anwendung bereits containerisierbar ist. Schritt 4 und 5 folgen in der zweiten Iteration.

Wer den Infrastruktur-Teil überspringen möchte, kann mit lowcloud starten, einer Kubernetes-DevOps-as-a-Service-Plattform, die speziell für Teams entwickelt wurde, die keine Kubernetes-Experten sind. Die Plattform übernimmt Cluster-Management, Networking und Basis-Observability, sodass Entwickler sich auf ihre Anwendungen konzentrieren können. Das reduziert den Einstiegsaufwand erheblich und erlaubt es, den Fokus dort zu lassen, wo er hingehört: auf den Code.

Minimalistische Cloud-Architektur: Weniger ist stabiler

Warum weniger Komponenten in der Cloud mehr Stabilität bringen – und wie Teams Kubernetes-Komplexität gezielt reduzieren können.

EU Data Act: Was Unternehmen und DevOps-Teams wissen müssen

Der EU Data Act gilt seit 2025. Was er für Cloud-Dienste, Datenportabilität und DevOps bedeutet – und was Unternehmen jetzt tun sollten.