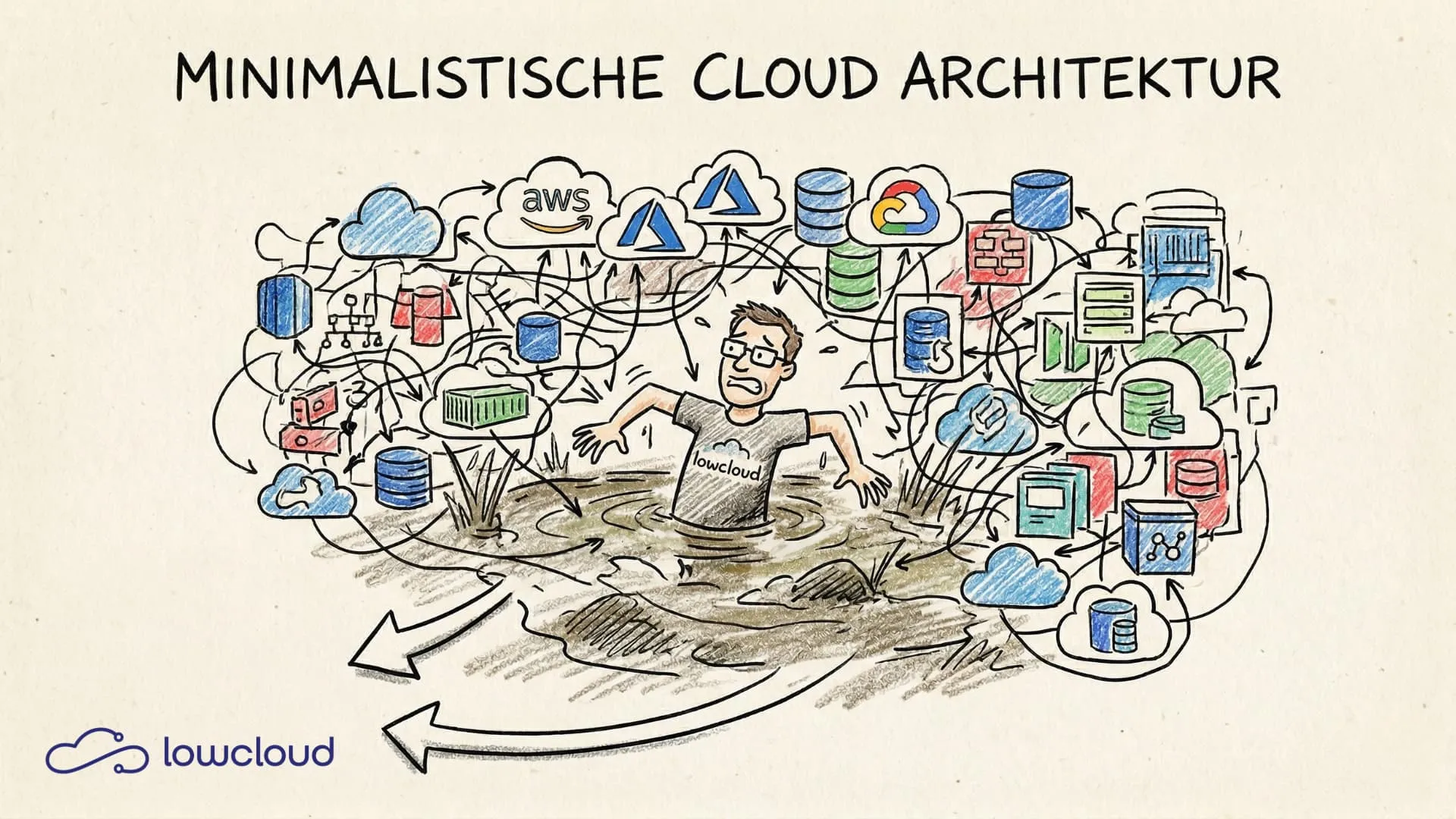

Minimalistische Cloud-Architektur: Weniger ist stabiler

Kubernetes-Cluster mit acht verschiedenen Operatoren, drei unterschiedlichen Service-Mesh-Implementierungen und einer CI/CD-Pipeline, die niemand mehr ohne Dokumentation versteht. Das ist kein Extrembeispiel, das ist der Normalzustand in vielen Unternehmen, die in den letzten Jahren zügig in die Cloud gewechselt haben. Das Problem dabei ist nicht die Technik. Es ist die stillschweigende Annahme, dass mehr Komponenten gleichbedeutend sind mit mehr Können.

Minimalistische Cloud-Architektur dreht diese Annahme um.

Komplexität ist kein Zeichen von Reife

Es gibt einen gut dokumentierten Reflex in Entwicklungsteams: Wenn eine neue Technologie existiert und ein reales Problem löst, wird sie eingesetzt, auch wenn das bestehende Problem bereits gelöst ist. Das Ergebnis sind Infrastrukturen, die aus dem ehrlichen Wunsch entstanden sind, Dinge gut zu machen, aber deren operationale Last mit der Zeit alle anderen Vorteile überwiegt.

Komplexität hat reale Kosten, die sich im Alltag zeigen:

- Längere Incident-Response-Zeiten. Wenn fünf Systeme an einem Request beteiligt sind, dauert die Fehlersuche fünfmal so lang.

- Schwieriges Onboarding. Neue Teammitglieder brauchen Wochen, um zu verstehen, was eigentlich passiert.

- Kognitiver Overhead. Wer täglich mit zehn verschiedenen Abstraktion arbeitet, macht mehr Fehler.

- Wachsende Security-Angriffsfläche. Jede zusätzliche Komponente ist ein potenzieller Angriffsvektor.

Der Unterschied zwischen einer guten und einer schlechten Architektur liegt nicht in der Anzahl der eingesetzten Technologien. Er liegt darin, ob jede Komponente einen klar messbaren Nutzen bringt, der ihren Wartungsaufwand rechtfertigt.

Was minimalistische Cloud-Architektur wirklich bedeutet

Minimalismus in der Cloud bedeutet nicht, auf Skalierbarkeit zu verzichten oder mit einem einzigen Container auf einem einzelnen Server zu arbeiten. Es bedeutet, bewusst zu entscheiden, welche Teile eines Systems wirklich gebraucht werden und den Rest wegzulassen.

Das klingt trivial. In der Praxis ist es schwierig, weil Weglassen aktive Entscheidungen erfordert, während Hinzufügen meistens der Weg des geringsten Widerstands ist.

Das Prinzip des minimalen Footprints

Jede Komponente, die in einer Architektur existiert, muss eine Frage beantworten: Was passiert, wenn wir sie entfernen? Wenn die Antwort "nicht viel" oder "wir sind uns nicht sicher" ist, ist das ein Signal. Ein gutes Architektur-Review stellt genau diese Fragen regelmäßig, nicht beim initialen Design, sondern alle paar Monate, weil Systeme sich verändern und gestern notwendige Komponenten heute redundant sein können.

Konkret bedeutet das:

- Kein Sidecar, der nicht aktiv genutzte Daten liefert

- Kein Operator, dessen Custom Resources niemand im Team täglich anfasst

- Kein Managed Service, dessen Mehrwert sich nicht in reduzierten Betriebsaufwand übersetzen lässt

Managed Services: Vereinfachung oder verdeckte Komplexität?

Managed Services werden oft als Lösung für Komplexität vermarktet. Das stimmt manchmal. Ein Managed Database Service eliminiert Backup-Management, Patching und Failover-Konfiguration. Das ist echte Vereinfachung.

Aber Managed Services können Komplexität auch nur verschieben. Wenn ein Team fünf verschiedene Managed Services nutzt, die alle eigene Konfigurationssprachen, Monitoring-Endpoints und IAM-Konzepte mitbringen, ist das Gesamtsystem komplexer als vorher, auch wenn jede einzelne Komponente "managed" ist. Die Frage ist nicht "Managed oder Self-Hosted?", sondern "Vereinfacht das unseren gesamten Betrieb?"

Kubernetes und der Hang zum Aufblähen

Kubernetes ist als Plattform flexibel genug, um nahezu jede Architekturentscheidung zu unterstützen. Das ist eine Stärke und ein Problem. Die Flexibilität verführt dazu, Probleme immer auf Infrastruktur-Ebene lösen zu wollen, auch wenn die Lösung eigentlich in der Anwendung oder im Prozess liegt.

Typische Muster, die Kubernetes-Setups unnötig komplex machen:

Operator-Inflation. Für jede Datenbank, jeden Message Broker und jedes Monitoring-Tool gibt es einen Operator. Jeder Operator bringt eigene Custom Resource Definitions, eigene RBAC-Regeln und eigene Update-Zyklen mit. Zehn Operatoren bedeuten zehn potenzielle Konfliktquellen und zehn separate Update-Prozesse – ein typisches Zeichen von DevOps-Tool-Sprawl.

Sidecar-Overload. Service Meshes wie Istio oder Linkerd injizieren Sidecar-Container in jeden Pod. Das bringt mTLS, Traffic-Management und Observability, aber auch doppelten Ressourcenverbrauch und eine zusätzliche Schicht, die konfiguriert, geupdated und debuggt werden muss. Für viele Teams ist das Verhältnis von Nutzen zu Aufwand ungünstig.

Custom Controller Sprawl. Sobald Teams anfangen, eigene Kubernetes-Operatoren zu schreiben, steigt der Wartungsaufwand exponentiell. Jeder Custom Controller ist Code, der maintained werden muss und meistens von denselben Leuten, die auch die eigentliche Anwendung bauen.

Praktische Muster für schlanke Cluster

Ein paar Prinzipien, die in der Praxis einen Unterschied machen:

Namespace-Strategie vereinfachen. Viele Teams arbeiten mit dutzenden Namespaces, die kaum unterschiedliche Isolation bieten, aber die RBAC-Konfiguration vervielfachen. Wenige, klar abgegrenzte Namespaces mit sauber definierten Grenzen funktionieren besser.

Ingress-Konfiguration minimal halten. Ein einzelner Ingress-Controller mit standardisierten Annotations reicht für die meisten Workloads aus. Spezialrouting, das sich in hundert verschiedenen Ingress-Objekten versteckt, macht Debugging unnötig schwierig. Wie sich Kubernetes-Konfiguration gezielt vereinfachen lässt, zeigt unser separater Artikel.

Ressourcen-Defaults setzen. Statt jeder Deployment-Definition individuelle Resource Requests und Limits mitzugeben, arbeiten LimitRanges und ResourceQuotas auf Namespace-Ebene sauberer und reduzieren Copy-Paste-Fehler.

Was minimalistische Architektur in der Praxis bringt

Die Vorteile einer schlankeren Architektur zeigen sich nicht sofort, aber sie sind messbar.

Stabilität. Weniger Komponenten bedeuten weniger mögliche Ausfallursachen. In einem System mit fünf statt fünfzehn Teilen ist die Wahrscheinlichkeit, dass gleichzeitig zwei Komponenten ein Problem haben, signifikant geringer. Das klingt trivial, hat aber echte Auswirkungen auf die Verfügbarkeit.

Kürzere Incident-Response. Wenn ein Alert ausgelöst wird und das Team die Architektur vollständig im Kopf hat, dauert die Fehlersuche Minuten statt Stunden. Observability-Daten sind übersichtlicher, Trace-Daten weniger verrauscht, und die Anzahl möglicher Ursachen ist kleiner.

Einfacheres Onboarding. Neue Entwickler, die eine Architektur in einem halben Tag verstehen können, werden schneller produktiv. Das hat direkten Einfluss auf die Teamkapazität – besonders bei wachsenden Teams oder häufigen Personalwechseln.

Kleinere Security-Angriffsfläche. Jeder laufende Prozess, jeder exponierte Service, jede Netzwerkverbindung ist ein potenzieller Angriffsvektor. Eine minimalistische Architektur hat strukturell weniger davon. Dazu kommt, dass weniger Komponenten auch weniger CVEs bedeuten, die regelmäßig gepatcht werden müssen.

Niedrigere Betriebskosten. Das ist oft der überzeugendste Punkt für Entscheider: weniger laufende Services bedeuten weniger Compute-Kosten, weniger Lizenzgebühren für Managed Services und weniger Zeit, die in Maintenance fließt.

Wann Komplexität gerechtfertigt ist

Minimalismus ist kein absolutes Prinzip. Es gibt Situationen, in denen Komplexität nicht vermeidbar ist und es wäre unehrlich, das zu verschweigen.

Multi-Region-Deployments mit aktiver Aktiv-Aktiv-Konfiguration sind komplex, weil das Problem komplex ist. Datenbank-Replikation über Regionen hinweg, Conflict-Resolution bei verteilten Schreiboperationen und Netzwerklatenz-Management lassen sich nicht wegdefinieren.

Systeme mit harten Compliance-Anforderungen, etwa im Finanz- oder Gesundheitsbereich, brauchen manchmal Audit-Trails, Verschlüsselungsschichten und Zugriffskontrollen, die einfachere Systeme nicht benötigen.

Der Unterschied ist: In diesen Fällen ist die Komplexität eine direkte Konsequenz einer echten Anforderung. Jedes Team sollte für jede Architekturentscheidung beantworten können, welche Anforderung sie erzwingt. Wenn die Antwort "weil wir das irgendwann mal brauchen könnten" ist, ist das kein guter Grund.

Der Plattform-Ansatz als strukturelle Antwort auf Komplexität

Eines der Kernprobleme bei Kubernetes-Infrastrukturen in wachsenden Teams ist, dass Komplexität sich verteilt. Jedes Team, das Kubernetes-Workloads betreibt, muss sich mit Ingress, RBAC, Resource Management, Monitoring-Konfiguration und Deployment-Prozessen beschäftigen. Das führt zu inkonsistenten Setups, doppelter Arbeit und unterschiedlichen Sicherheitsstandards über Teams hinweg.

Ein Plattform-Ansatz löst dieses Problem strukturell: Statt jedes Team seine eigene Infrastruktur Komplexität verwalten zu lassen, zieht eine gemeinsame Plattform diese Themen nach oben und stellt sie standardisiert bereit. Teams deployen Anwendungen, sie konfigurieren nicht zum zwanzigsten Mal denselben Ingress-Controller. Zero-Config-Ansätze machen genau das möglich.

Das ist der Kern, auf dem lowcloud aufbaut: eine Kubernetes-DevOps-as-a-Service-Plattform, die Infrastruktur-Komplexität zentralisiert, sodass Entwicklungsteams sich auf ihre Anwendungen konzentrieren können. Wer wissen möchte, wie das in der Praxis aussieht, findet auf der lowcloud-Plattform konkrete Antworten auf die Frage, wie man Kubernetes-Betrieb vereinfacht, ohne an Kontrolle zu verlieren.

Minimalistische Cloud-Architektur ist kein Trend und kein Gegenentwurf zu modernen Cloud-Praktiken. Es ist die Konsequenz aus der Erkenntnis, dass jede Komponente Kosten hat – auch wenn sie gerade keine Probleme macht. Wer regelmäßig hinterfragt, was wirklich gebraucht wird, baut Systeme, die langfristig besser funktionieren.

Zero-Config Kubernetes: Warum Einfachheit gewinnt

Kubernetes-Konfiguration kostet Teams täglich Stunden. Wie Zero-Configuration-Ansätze mit sinnvollen Defaults Deployments vereinfachen und Produktivität steigern.

Software Deployment KMU: Schneller und sicherer ausrollen

Wie kleine Teams mit CI/CD, PaaS und GitOps von manuellen Deployments zu automatisierten Workflows kommen, ohne ein Platform-Team aufzubauen.