Kubernetes vs. Docker Swarm: Unterschiede und warum K8s gewonnen hat

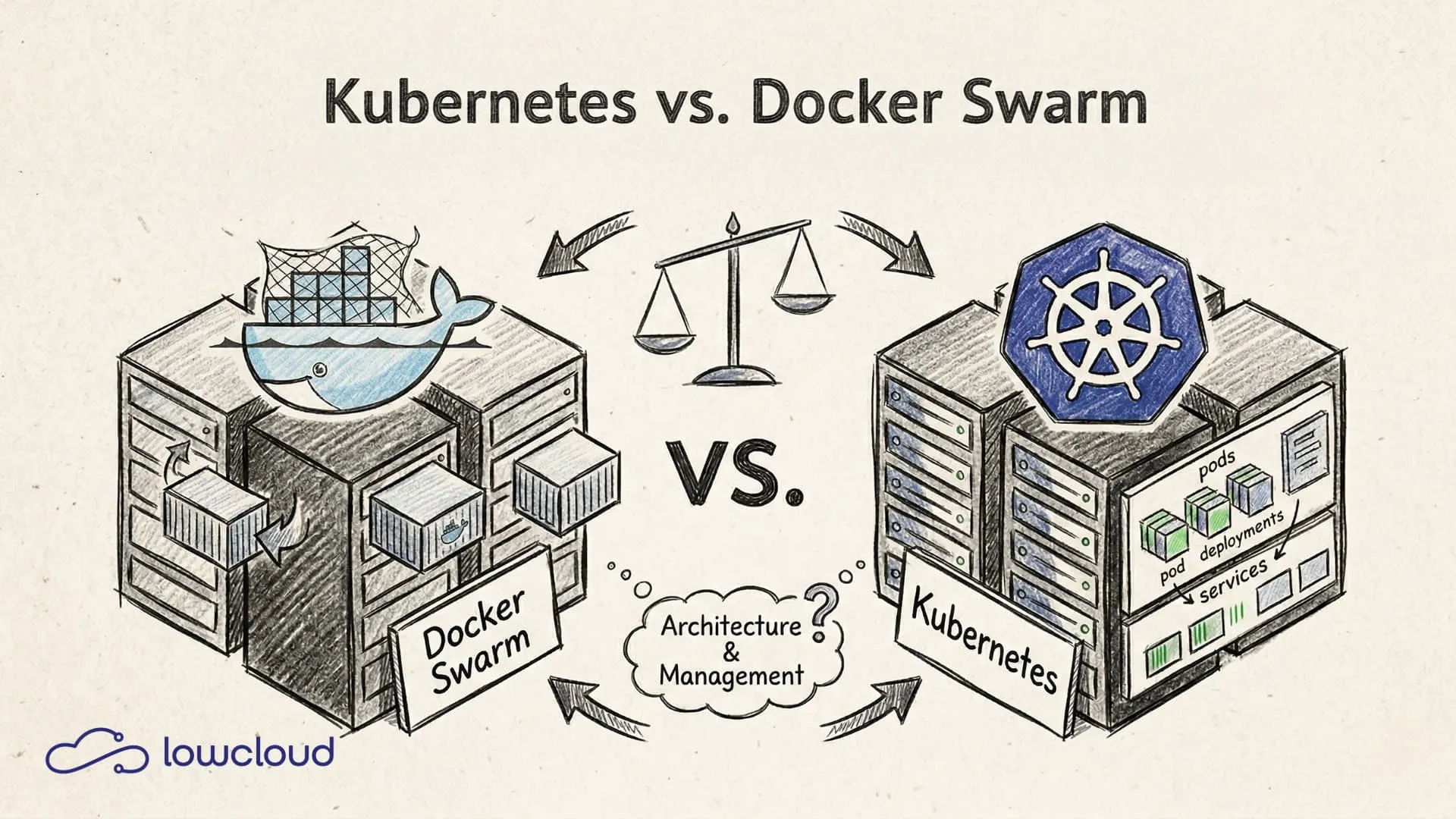

Wer Container in Produktion bringen will, braucht eine Antwort auf eine einfache Frage: Wer entscheidet, wo welcher Container läuft, wie er skaliert wird und was passiert, wenn ein Node ausfällt? Genau das ist Container-Orchestrierung. Und hier stehen sich zwei Namen gegenüber, die lange miteinander verglichen wurden: Kubernetes und Docker Swarm.

Kubernetes vs. Docker Swarm ist kein akademischer Vergleich mehr. Der Markt hat entschieden, aber es lohnt sich trotzdem zu verstehen, warum, und wann Swarm immer noch eine valide Option sein kann. Wer Docker, Compose, Swarm und Kubernetes im breiteren Überblick vergleichen will, findet dort die Einordnung aller vier Werkzeuge.

Was ist Docker Swarm?

Docker Swarm ist die native Clustering-Lösung von Docker. Sie ist direkt in den Docker-Daemon integriert, was den größten Vorteil gleichzeitig zum größten Nachteil macht: Man braucht kaum etwas dazuzulernen, wenn man Docker kennt. Ein Swarm-Cluster ist in Minuten aufgebaut.

Im Kern besteht ein Swarm aus Manager-Nodes und Worker-Nodes. Manager koordinieren den Cluster-State und verteilen Tasks, Worker führen Container aus. Die Konfiguration erfolgt über docker-compose-ähnliche Stack-Dateien, die meisten Docker-Entwickler fühlen sich sofort heimisch.

Das ist auch der Grund, warum Swarm eine Zeit lang attraktiv war: keine neue Abstraktionsschicht, keine neue Toolchain, keine steile Lernkurve. Einfach Docker, aber verteilt.

Was ist Kubernetes?

Kubernetes hat eine andere Herkunft. Es entstand bei Google als Open-Source-Variante des internen Borg-Systems, das Googles gesamte Infrastruktur koordiniert. Seit 2016 liegt es bei der Cloud Native Computing Foundation (CNCF) und ist heute das am weitesten verbreitete Container-Orchestrierungssystem der Welt.

Die Architektur ist komplexer als Swarm. Ein Kubernetes-Cluster besteht aus:

- Control Plane: API-Server (zentraler Einstiegspunkt), etcd (verteilter Key-Value-Store für den Cluster-State), Scheduler (entscheidet, auf welchem Node ein Pod läuft), Controller Manager (hält den gewünschten State aufrecht).

- Worker Nodes: Laufen auf jedem Node – kubelet (kommuniziert mit dem API-Server), kube-proxy (Netzwerkregeln), Container Runtime (z.B. containerd).

Die grundlegende Einheit ist nicht der Container, sondern der Pod**,** eine Gruppe aus einem oder mehreren eng zusammenarbeitenden Containern, die sich einen Netzwerk-Namespace teilen.

Kubernetes vs. Docker Swarm. Die wichtigsten Unterschiede

Architektur und Komplexität

Swarm ist einfach. Das ist kein Werturteil, sondern eine technische Tatsache. Die geringere Komplexität macht den Einstieg leicht, wird aber zum Problem, sobald Anforderungen wachsen. Kubernetes hat mehr bewegliche Teile und das aus gutem Grund.

Mit Kubernetes bekommst du feine Kontrolle über jeden Aspekt des Deployments: ResourceRequests und ResourceLimits pro Container, PodDisruptionBudgets, PriorityClasses, Taints und Tolerations für gezieltes Scheduling. Das ist kein Feature-Overkill, das sind Werkzeuge, die in Produktionsumgebungen früher oder später gebraucht werden.

Skalierung und Scheduling

Docker Swarm skaliert Services horizontal, du erhöhst die Replica-Anzahl, fertig. Das funktioniert, ist aber manuell oder braucht externe Tooling.

Kubernetes hat dafür native Konzepte eingebaut:

- Horizontal Pod Autoscaler (HPA): Skaliert Pods automatisch anhand von CPU-, Memory- oder Custom-Metriken.

- Vertical Pod Autoscaler (VPA): Passt ResourceRequests automatisch an.

- Cluster Autoscaler: Fügt bei Bedarf neue Nodes zum Cluster hinzu, in Cloud-Umgebungen vollautomatisch.

Der Scheduler in Kubernetes ist zudem deutlich ausgereifter. Er berücksichtigt Node-Affinitäten, Ressourcenverfügbarkeit, Spread-Constraints und mehr. Bei Swarm läuft ein Task irgendwo, bei Kubernetes läuft er genau da, wo er hingehört.

Netzwerk

Kubernetes verwendet das CNI-Modell (Container Network Interface). Das bedeutet: Du wählst ein Netzwerk-Plugin, das deinen Anforderungen entspricht – Calico für NetworkPolicies und Security, Flannel für Einfachheit, Cilium für eBPF-basiertes Hochleistungs-Networking.

# NetworkPolicy-Beispiel: nur Port 80 von bestimmten Pods erlauben

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-frontend

spec:

podSelector:

matchLabels:

app: backend

ingress:

- from:

- podSelector:

matchLabels:

app: frontend

ports:

- port: 80

Swarm hat ein eingebautes Overlay-Netzwerk, das out-of-the-box funktioniert. Aber feingranulare Netzwerkregeln, Service-Meshes oder fortgeschrittene Traffic-Policies sind damit kaum umsetzbar.

Storage und Persistenz

Stateful Workloads sind eine der größten Herausforderungen in Container-Umgebungen. Kubernetes adressiert das mit einem ausgereiften Storage-Modell:

- PersistentVolumes (PV): Abstraktion über den tatsächlichen Speicher (NFS, Ceph, Cloud-Disks etc.)

- PersistentVolumeClaims (PVC): Anforderung eines PVs durch einen Pod

- StorageClasses: Dynamische Provisionierung von Storage on demand

- StatefulSets: Spezieller Workload-Typ für Datenbanken und andere stateful Anwendungen mit stabilen Netzwerkidentitäten

Swarm kennt Volumes, aber das Konzept ist bei weitem nicht so ausgereift. Wer Datenbanken im Cluster betreibt, wird mit Swarm früh an Grenzen stoßen.

Self-Healing und Resilienz

Beide Systeme starten ausgefallene Container neu. Kubernetes geht weiter: Es erkennt fehlgeschlagene Health Checks, entfernt entsprechende Pods aus dem Service-Loadbalancing, bevor sie neu gestartet werden, und verteilt Workloads bei Node-Ausfall automatisch um.

Liveness Probes und Readiness Probes sind in Kubernetes First-Class-Citizens, jedes Deployment kann damit konfiguriert werden, wie der Cluster den Gesundheitszustand eines Containers bestimmt. Wer das einmal sauber eingerichtet hat, möchte nicht mehr darauf verzichten.

Wann macht Docker Swarm noch Sinn?

Ehrlich gesagt: in immer weniger Situationen. Aber es gibt sie noch.

Wenn du ein kleines Team hast, das Docker bereits kennt, eine überschaubare Anzahl von Services betreibt und keine komplexen Skalierungsanforderungen hat, dann ist Swarm schneller aufgebaut und einfacher zu betreiben. Für interne Tools, Staging-Umgebungen oder kleine SaaS-Setups mit statischen Workloads ist der Overhead von Kubernetes manchmal schwer zu rechtfertigen.

Das Problem: Diese Situationen sind selten stabil. Workloads wachsen, Anforderungen ändern sich, und eine Migration von Swarm zu Kubernetes mitten in einer Wachstumsphase ist unangenehm. Viele Teams, die früh auf Swarm gesetzt haben, bereuen diese Entscheidung später.

Dazu kommt: Docker hat Swarm nicht aktiv weiterentwickelt. Es ist nicht tot, aber es stagniert, während Kubernetes mehrfach im Jahr neue Features bekommt.

Warum Kubernetes der Standard geworden ist

Es wäre zu einfach zu sagen, Kubernetes hat gewonnen, weil es besser ist. Die Realität ist differenzierter, aber die Schlussfolgerung ist dieselbe.

Ökosystem: Rund um Kubernetes ist ein riesiges Ökosystem entstanden. Helm für Package Management, Argo CD für GitOps-Deployments, Istio oder Linkerd für Service Meshes, Prometheus und Grafana für Monitoring, Cert-Manager für TLS-Automatisierung. Jedes dieser Tools löst ein echtes Problem, das Swarm alleine nicht adressiert.

Cloud-Support: AWS (EKS), Google (GKE) und Azure (AKS) bieten Managed Kubernetes als First-Class-Service. Node-Provisioning, Control-Plane-Management, Updates, Security-Patches, das übernimmt der Cloud-Provider. Managed Swarm existiert nicht mehr in vergleichbarer Form.

Community und Zukunftssicherheit: Kubernetes wird von Hunderten Unternehmen und Tausenden Contributors entwickelt. Die CNCF sorgt für neutrale Governance. Wer heute in Kubernetes investiert, investiert in eine Technologie, die in fünf Jahren noch existiert, das ist bei Swarm weniger sicher.

Standardisierung: Wer Kubernetes kennt, kann auf jedem Cloud-Provider, on-premise und auf Bare Metal arbeiten. Das Wissen ist portabel. Kubernetes ist zum gemeinsamen Nenner der Branche geworden, was die Zusammenarbeit, das Hiring und den Einsatz externer Tooling vereinfacht.

Was bedeutet das für dein Team?

Kubernetes ist der richtige Weg, aber das bedeutet nicht, dass der Einstieg einfach ist. Die Lernkurve ist real. YAML-Manifeste, Custom Resource Definitions, RBAC, Ingress-Controller, Storage-Konfiguration, das sind alles Themen, in die man sich einarbeiten muss.

Für Teams, die Kubernetes produktiv einsetzen wollen, ohne die gesamte Infrastruktur selbst zu verwalten, gibt es einen pragmatischen Mittelweg: Kubernetes-basierte DevOps-as-a-Service-Plattformen. Diese abstrahieren die Komplexität des Cluster-Managements, ohne die Vorteile von Kubernetes aufzugeben.

lowcloud ist eine solche Plattform, gebaut auf Kubernetes, betrieben auf europäischer Infrastruktur, gedacht für Entwicklungsteams, die sich auf ihre Anwendungen konzentrieren wollen, nicht auf Cluster-Management. Wer Kubernetes nutzen will, ohne ein dediziertes Platform-Team aufzubauen, findet dort einen direkten Weg in die Produktion.

lowcloud vs. DevOps-as-a-Service-Anbieter im Vergleich

DaaS-Plattform oder externer Dienstleister? Vergleich von Kosten, Kontrolle, Vendor-Lock-in und Compliance bei DevOps-Outsourcing für KMU.

Hetzner Kubernetes Hosting mit lowcloud

Kubernetes auf Hetzner ohne Betriebsaufwand: lowcloud kombiniert günstige EU-Infrastruktur mit vollständigem Cluster-Management für Produkt-Teams.