Funktionsweise

Zuletzt aktualisiert: 16. März 2026

lowcloud ist eine DevOps-Plattform, die Kubernetes für Teams zugänglich macht, ohne dass du Kubernetes-Experte sein musst. Infrastruktur, Deployments und Monitoring werden über eine einheitliche Oberfläche gesteuert.

Das große Bild

lowcloud fungiert als zentraler Control Plane zwischen dir und deiner Cloud-Infrastruktur. Statt dich mit kubectl, Helm CLI, CI/CD-Pipelines und Monitoring-Stacks auseinanderzusetzen, steuerst du alles über das lowcloud Dashboard:

- Infrastruktur — Kubernetes-Cluster automatisch provisionieren und skalieren

- Deployments — Anwendungen und Services deployen, updaten und verwalten

- Monitoring — Cluster und Anwendungen überwachen, Alerts bei Problemen

Deine Infrastruktur läuft dabei auf deinem Cloud-Account. lowcloud verwaltet sie, du behältst die volle Kontrolle.

Warum Kubernetes?

Kubernetes ist der Industriestandard für Container-Orchestrierung. Es bietet:

- Selbstheilung — Fehlerhafte Container werden automatisch neu gestartet

- Skalierung — Horizontal und vertikal, manuell oder automatisch

- Rolling Updates — Zero-Downtime Deployments out of the box

- Service Discovery — Services finden sich automatisch im Cluster

Das Problem: Kubernetes ist komplex. Die Lernkurve ist steil, und der operative Aufwand für Cluster-Management, Networking, Storage und Security ist erheblich. Genau hier setzt lowcloud an. Du bekommst alle Vorteile von Kubernetes, ohne die Komplexität selbst managen zu müssen.

Deine Infrastruktur, deine Kontrolle

lowcloud ist kein Shared-Hosting. Deine Cluster laufen auf deinem Cloud-Account bei deinem Cloud Provider. Das bedeutet:

- Keine Vendor Lock-in — Deine Infrastruktur gehört dir. Du kannst jederzeit ohne lowcloud weiterarbeiten.

- Volle Transparenz — Du siehst genau, welche Ressourcen laufen und was sie kosten.

- Datenhoheit — Deine Daten bleiben auf deiner Infrastruktur, in der Region deiner Wahl.

lowcloud verbindet sich über API-Credentials mit deinem Cloud Provider und verwaltet die Infrastruktur in deinem Namen.

Der Workflow

1. Cloud Provider verbinden

Hinterlege deine Cloud API-Credentials in lowcloud. lowcloud nutzt diese, um Ressourcen in deinem Account zu provisionieren.

2. Cluster provisionieren

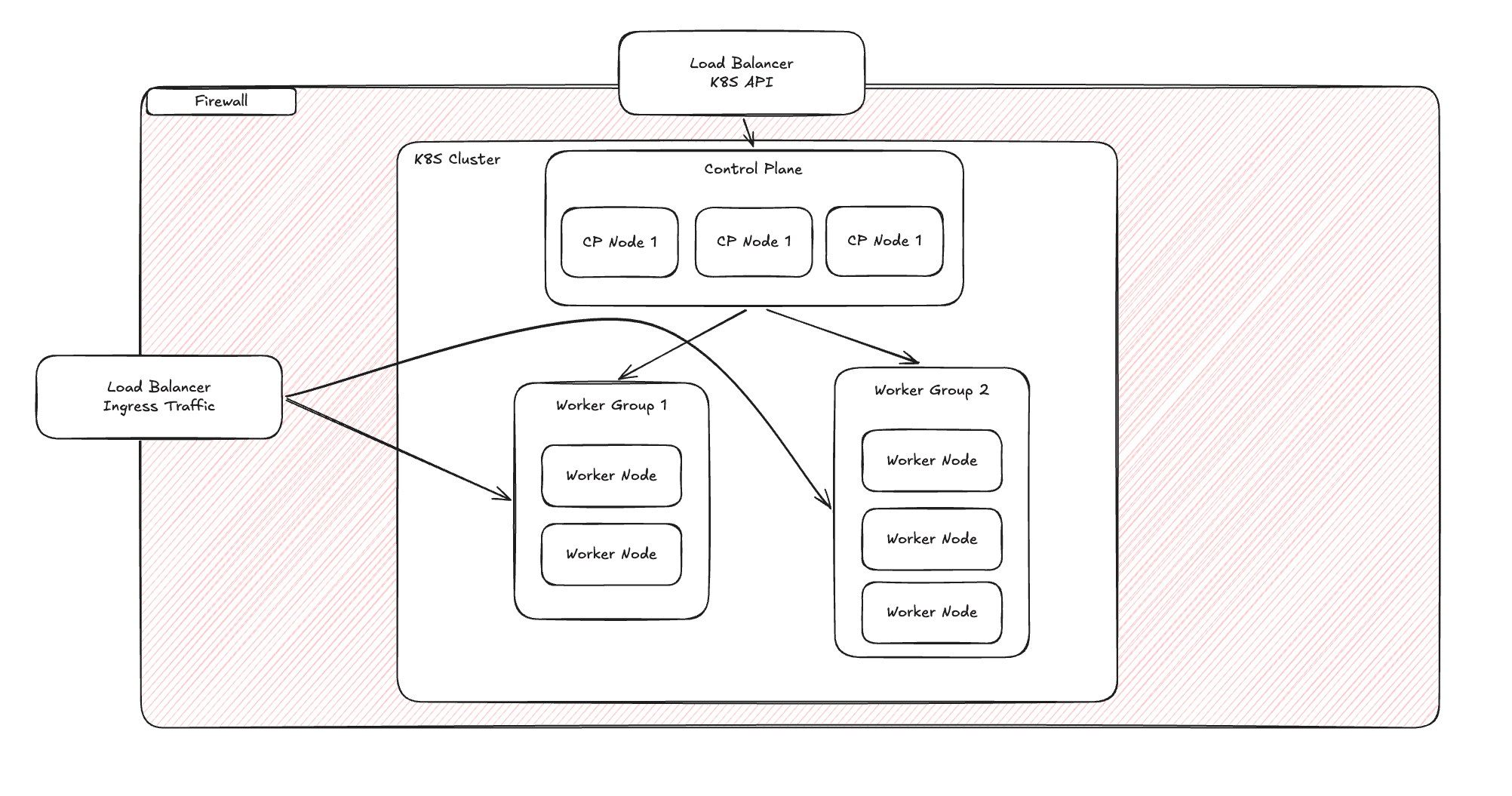

lowcloud erstellt auf Basis von ClusterAPI vollständig automatisiert Kubernetes-Cluster. Das umfasst Control Plane, Worker Nodes, Netzwerk und Load Balancer. Die gesamte Infrastruktur wird deklarativ verwaltet und lässt sich jederzeit skalieren.

Beim Provisionieren erstellt lowcloud die folgenden Ressourcen in deinem Cloud Account:

- Firewall — Sichert das gesamte Cluster ab, indem nur notwendige Ports und Protokolle zugelassen werden.

- Load Balancer (K8S API) — Verteilt Anfragen an die Kubernetes API über die Control Plane Nodes für Hochverfügbarkeit.

- Load Balancer (Ingress Traffic) — Leitet externen HTTP/HTTPS-Traffic an deine Anwendungen im Cluster weiter.

- Control Plane Nodes — Drei Nodes, die die Kubernetes Control Plane für Redundanz und Hochverfügbarkeit betreiben.

- Worker Groups — Gruppen von Worker Nodes, auf denen deine Anwendungen und Services laufen. Du kannst mehrere Worker Groups mit unterschiedlichen Maschinentypen konfigurieren, um sie an deine Workload-Anforderungen anzupassen.

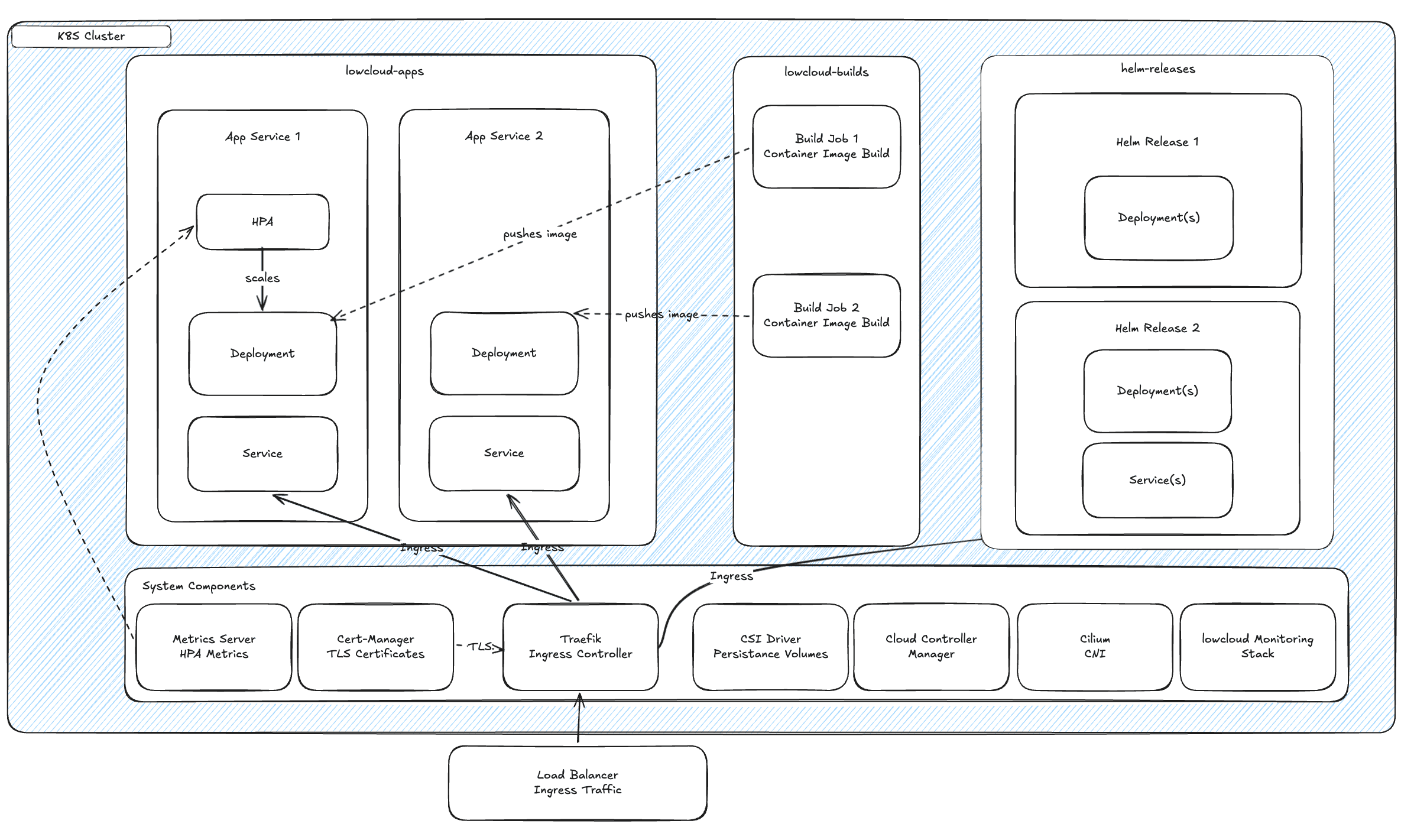

Dein Cluster von innen

Nach dem Provisionieren richtet lowcloud alles ein, was deine Anwendungen im Cluster brauchen.

Dein Cluster ist in dedizierte Namespaces organisiert:

- lowcloud-apps — Deine Anwendungen. Jede App wird aus einem verbundenen GitHub-Repository gebaut, als Kubernetes Deployment bereitgestellt und über einen Service erreichbar gemacht.

- lowcloud-builds — Container Image Build Jobs. Wenn du Code pushst, erstellt lowcloud hier Build Jobs, die Container Images für deine Apps bauen.

- helm-<releasename> — Jedes Helm Release läuft in seinem eigenen Namespace (z.B.

helm-postgresql,helm-redis). Jedes Release betreibt eigene Deployments und Services.

lowcloud installiert und verwaltet außerdem automatisch essentielle Systemkomponenten:

- Traefik — Ingress Controller, der externen Traffic an deine Services routet

- Cert-Manager — Automatische TLS-Zertifikatsbereitstellung und -erneuerung

- Cilium — Container-Networking (CNI) für Pod-zu-Pod-Kommunikation

- CSI Driver — Persistent Volume Provisioning für stateful Workloads

- Cloud Controller Manager — Integration mit Cloud Provider APIs für Load Balancer und Nodes

- Metrics Server — Sammelt Ressourcen-Metriken für Autoscaling (HPA)

- lowcloud Monitoring Stack — Integriertes Monitoring und Alerting

3. Anwendungen deployen

Deploye deine Anwendungen über einen von zwei Wegen:

- Container Apps — Verbinde ein GitHub-Repository. lowcloud erkennt Code-Änderungen, baut Container Images und deployt sie automatisch in dein Cluster.

- Helm Releases — Deploye vorkonfigurierte Services wie PostgreSQL, Redis oder n8n direkt aus Helm Chart Registries.

4. Überwachen und skalieren

lowcloud überwacht deine Cluster und Anwendungen kontinuierlich. Bei Problemen wie hoher Ressourcenauslastung oder fehlgeschlagenen Deployments wirst du automatisch benachrichtigt. Cluster und Anwendungen lassen sich jederzeit hoch- oder herunterskalieren.

Was du deployen kannst

| Typ | Beschreibung | Beispiele |

|---|---|---|

| Container Apps | Eigene Anwendungen aus GitHub-Repositories | Web-Apps, APIs, Worker, Cronjobs |

| Helm Releases | Vorkonfigurierte Services aus Chart Registries | PostgreSQL, Redis, n8n, Grafana |

Container Apps

Verbinde dein GitHub-Repository und eine Container Registry. lowcloud baut deine App bei jedem Push automatisch als Container Image, pusht es in die Registry und deployt es in dein Cluster.

Helm Releases

Für Datenbanken, Caches und andere Infrastruktur-Services nutzt du Helm Releases. Gib eine Chart Registry an, konfiguriere die Values und deploye. Das gesamte Management läuft über das Dashboard. Mit Helm Release Dependencies verknüpfst du Services untereinander, sodass lowcloud die Startreihenfolge und Service Discovery automatisch übernimmt.

Monitoring & Alerting

Monitoring und Alerting sind out-of-the-box integriert und erfordern keine zusätzliche Konfiguration. lowcloud überwacht:

- Cluster-Gesundheit — Node-Status, Ressourcenauslastung, Kubernetes-Events

- Anwendungen — Pod-Status, Restarts, Deployment-Fortschritt

- Benachrichtigungen — Automatische Alerts bei Problemen